标签:mic proc 发送 discard 存在 sts ssid dup word

Cookie,指某些网站为了辨别用户身份、进行session跟踪而储存在用户本地终端上的数据(通常经过加密)

比如说有些网站需要登录后才能访问某个页面,在登录之前,你想抓取某个页面内容是不允许的。那么我们可以利用Urllib2库保存我们登录的Cookie,然后再抓取其他页面就达到目的了。

在此之前呢,先介绍一个opener的概念

当你获取一个URL你使用一个opener(一个urllib2.OpenerDirector的实例)。在前面,我们都是使用的默认的opener,也就是urlopen。它是一个特殊的opener,可以理解成opener的一个特殊实例,传入的参数仅仅是url,data,timeout。

如果我们需要用到Cookie,只用这个opener是不能达到目的的,所以我们需要创建更一般的opener来实现对Cookie的设置。

cookielib模块的主要作用是提供可存储cookie的对象,以便于与urllib2模块配合使用来访问Internet资源。Cookielib模块非常强大,我们可以利用本模块的CookieJar类的对象来捕获cookie并在后续连接请求时重新发送,比如可以实现模拟登录功能。该模块主要的对象有CookieJar、FileCookieJar、MozillaCookieJar、LWPCookieJar。

它们的关系:CookieJar —-派生—->FileCookieJar —-派生—–>MozillaCookieJar和LWPCookieJar

首先,我们先利用CookieJar对象实现获取cookie的功能,存储到变量中,先来感受一下

1 #coding:UTF8 2 3 import cookielib 4 import urllib2 5 6 #声明一个CookieJar对象实例来保存cookie 7 cookie = cookielib.CookieJar() 8 #利用HTTPCookieProcessor对象创建cookie处理器 9 handle = urllib2.HTTPCookieProcessor(cookie) 10 #通过handle来构建opener 11 opener = urllib2.build_opener(handle) 12 #此open方法与urllib2的urlopen方法,可以传入request 13 response = opener.open(‘http://www.baidu.com‘) 14 15 for i in cookie: 16 print ‘Name =‘ +i.name 17 print ‘Value = ‘ + i.value

使用以上方法将cookie保存到变量中,然后打印出了cookie中的值,运行结果如下

1 Name =BAIDUID 2 Value = 6E0127B9536DE7EE8A68D8B5AE016CCA:FG=1 3 Name =BIDUPSID 4 Value = 6E0127B9536DE7EE8A68D8B5AE016CCA 5 Name =H_PS_PSSID 6 Value = 1465_13550_21110_17001_21672_22158 7 Name =PSTM 8 Value = 1491037392 9 Name =BDSVRTM 10 Value = 0 11 Name =BD_HOME 12 Value = 0

在上面的方法中,我们将cookie保存到了cookie这个变量中,如果我们想将cookie保存到文件中该怎么做呢?这时,我们就要用到

FileCookieJar这个对象了,在这里我们使用它的子类MozillaCookieJar来实现Cookie的保存

1 #coding:UTF8 2 3 import cookielib 4 import urllib2 5 6 #设置保存cookie文件,在同级目录下 7 file_name=‘cookie.txt‘ 8 #声明一个CookieJar对象实例来保存cookie 9 cookie = cookielib.MozillaCookieJar(file_name) 10 #利用HTTPCookieProcessor对象创建cookie处理器 11 handle = urllib2.HTTPCookieProcessor(cookie) 12 #通过handle来构建opener 13 opener = urllib2.build_opener(handle) 14 #此open方法与urllib2的urlopen方法,可以传入request 15 response = opener.open(‘http://www.baidu.com‘) 16 17 cookie.save(ignore_discard=True,ignore_expires=True)

关于最后save方法的两个参数在此说明一下:

官方解释如下:

gnore_discard: save even cookies set to be discarded. ignore_expires: save even cookies that have expiredThe file is overwritten if it already exists

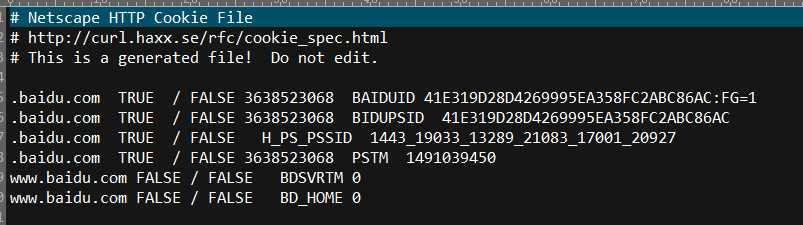

由此可见,ignore_discard的意思是即使cookies将被丢弃也将它保存下来,ignore_expires的意思是如果在该文件中cookies已经存在,则覆盖原文件写入,在这里,我们将这两个全部设置为True。运行之后,cookies将被保存到cookie.txt文件中,我们查看一下内容,附图如下

那么我们已经做到把Cookie保存到文件中了,如果以后想使用,可以利用下面的方法来读取cookie并访问网站,感受一下

1 #coding:UTF8 2 import urllib2 3 import cookielib 4 #创建实例对象 5 cookie = cookielib.MozillaCookieJar() 6 #从文件中读取cookie内容到变量 7 cookie.load(‘cookie.txt‘, ignore_discard=True,ignore_expires=True) 8 #创建请求 9 request = urllib2.Request(‘http://www.baidu.com‘) 10 #利用build_opener方法创建一个opener 11 opener = urllib2.build_opener(urllib2.HTTPCookieProcessor(cookie)) 12 13 req = opener.open(request) 14 print req.read()

设想,如果我们的 cookie.txt 文件中保存的是某个人登录百度的cookie,那么我们提取出这个cookie文件内容,就可以用以上方法模拟这个人的账号登录百度。

下面以本人博客园为例(账号密码都是假的哟,不信可以试试滴),利用cookie实现模拟登录,并将cookie信息保存到文本文件中,来感受一下cookie大法吧!

1 #coding:UTF8 2 3 import urllib 4 import urllib2 5 import cookielib 6 7 file_name = ‘cookie1.txt‘ 8 #声明一个MozillaCookieJar对象实例来保存cookie,之后写入文件 9 cookie = cookielib.MozillaCookieJar(file_name) 10 opener = urllib2.build_opener(urllib2.HTTPCookieProcessor(cookie)) 11 data = urllib.urlencode({ 12 ‘username‘:‘username‘, 13 ‘pwd‘:‘password‘, 14 }) 15 #登录博客园的URL 16 login_url = ‘https://passport.cnblogs.com/user/signin?ReturnUrl=http%3A%2F%2Fwww.cnblogs.com%2F‘ 17 #模拟登录,并把cookie保存到变量 18 result = opener.open(login_url,data) 19 #保存cookie到文件 20 cookie.save(ignore_discard=True, ignore_expires=True) 21 #利用cookie请求访问到另一网址 22 select_url=‘http://www.cnblogs.com/qianyuliang/p/6656580.html‘ 23 #请求访问 24 result = opener.open(select_url) 25 print result.read()

以上程序的原理如下

创建一个带有cookie的opener,在访问登录的URL时,将登录后的cookie保存下来,然后利用这个cookie来访问其他网址。

标签:mic proc 发送 discard 存在 sts ssid dup word

原文地址:http://www.cnblogs.com/qianyuliang/p/6657090.html