标签:mes 滤波器 时代 直接 使用外部 man 占用 利用 google

在ImageNet大规模视觉识别挑战赛2014(ILSVRC14)上我们提出了一种代号为 " Inception " 的深度卷积神经网络结构,且图像分类和检测上取得了新的最好结果。该体系结构的主要特点是提高了网络内的计算资源利用率。这是通过精心设计实现的,该设计允许在保持计算预算不变的同时增加网络的深度和宽度。为了网络的优化质量,架构设计基于Hebbian原则和多尺度处理直觉的基础。我们在为ILSVRC14 提交的模型文件中使用的一种特殊形式称为 " googlenet " ,它是一个22层深的网络,其质量将在分类和检测的背景下进行评估。

过去的三年中,主要由于深入学习和卷积网络的发展[10],图像识别和目标检测的能力正以前所未有的速度向前发展。一个令人鼓舞的消息是,这一进步的大部分不仅仅是更强大的硬件、更大的数据集和更大的模型的结果,而主要是新的想法、算法和网络结构的改进的结果。 例如,ILSVRC 2014竞赛中最靠前的输入除了用于检测目的的分类数据集之外,没有使用新的数据资源。我们的GoogleNet提交给ILSVRC 2014的报告实际上是两年前Krizhevsky等人[9]的获奖架构使用的参数的1/12,而且要更加准确。在目标检测方面,最大的收获不是来自于单独利用深度网络或更大的模型,而是来自于深层架构和经典计算机视觉的协同作用,比如Girshick等人[6]的R-CNN算法。

另一个显著的因素是,随着移动计算和嵌入式计算的不断发展,我们算法的效率变得越来越重要——尤其是它们对于的能力和内存的使用。 值得注意的是,正是包含了此因素的考虑才得出了本文中的深度架构设计,而不是简单的为了提高准确率。对于大多数实验,这些模型的设计是为了保持在推理时15亿乘加的计算预算,因而它们最终不是成为纯粹的学术好奇心,而是可以在合理的成本内投入现实世界的使用,即使是在大型数据集上也是如此。

本文将重点研究一种高效的计算机视觉深层神经网络体系结构,代号为 " Inception " ,它的名称来源于Lin等人[12]的网络论文中的网络,以及著名的“我们需要更深层次的”网络模因[1]。在我们的例子中," 深度 " 一词有两种不同的含义:首先,我们以“Inception模块”的形式引入了一个新的组织层次,并且在更直接的意义上增加了网络深度。一般来说,人们可以把初始模型看作是论文[12]的逻辑顶点,同时从Arora等人的理论工作中获得灵感和引导[2]。该架构的优点在ILSVRC 2014分类和检测挑战上得到了实验验证,在这方面,它的性能明显优于目前的先进水平。

从LeNet-5[10]开始,卷积神经网络(CNN)通常有一个标准的结构-堆叠的卷积层(后面可选择添加对比度归一化和最大池)后面是一个或多个全连接层。这种基本设计的变体在图像分类文献中尤为流行,并在mnist、CIFAR和ImageNet分类挑战[9,21]上取得了迄今为止最好的结果。对于大型数据集,如ImageNet,最近的趋势是增加层数[12]和层大小[21,14],同时使用Dropout[7]来解决过度拟合的问题。

尽管人们担心最大池化层会导致精确的空间信息丢失,但与[9]相同的卷积网络结构也被成功地用于定位[9,14],目标检测[6,14,18,5]和人体姿态估计[19]。

从灵长类视觉皮层神经科学模型得到启发,Serre等人[15]使用了一系列固定的不同大小的Gabor滤波器来处理多尺度。我们使用了一个相类似的结构。然而,与[15]中固定的2层深度模型相反,在 Inception 初始模型中的所有滤波器都是学习的。 此外,Inception层重复了多次,在GoogLeNet模型中得到了一个22层的深度模型。

Network-in-Network是Lin等人[12]为了增加神经网络表现能力而提出的一种方法。当应用于卷积层时,该方法可以看作是额外的1×1卷积层,然后是典型的校正线性激活[9]。这使得它能够很容易地集成到目前的CNN管道中。我们在架构中大量使用这种方法。然而,在我们的设置中,1×1卷积具有双重用途:最关键的是,它们主要用作降维模块,以消除卷积计算的瓶颈,否则这将会限制我们的网络规模。这不仅允许增加网络的深度,而且还允许我们网络宽度增加而不会有显著的性能上损失。

目前主要的目标检测方法是Girshick等人提出的基于区域的卷积神经网络方法(R-CNN)[6]。R-CNN将整个检测问题分解为两个子问题:首先,通过一种类别无关的方式,利用颜色和超像素一致性等低层特征来产生潜在的目标位置候选区域,然后使用CNN分类器识别这些位置上的对象类别。 这样一种两个阶段的方法利用了低层特征分割边界框的准确性,也利用了当前CNN非常强大的分类能力。我们提交的检测报告中采用了类似的方法,但在这两个阶段都进行了改进,例如对于更高的目标边界框召回使用多盒[5]预测,以及更好地对边界框提案进行分类的集成方法。

改善深层神经网络性能最直接的方法是增加它们的大小。这包括增加网络的深度(层数)及其宽度:每层的单元数。这是一种简单而安全的方法来训练高质量的模型,特别是考虑到大量的标记训练数据的可用性。然而,这个简单的解决方案有两个主要缺点。

更大的规模通常意味着更多的参数,这使得扩大后的网络更容易过度拟合,特别是在训练集中标记示例的数量有限的情况下。这可能成为一个主要的瓶颈,因为创建高质量的培训集可能是棘手和昂贵的,特别是如果需要专家评估人员来区分像ImageNet(甚至在1000类ILSVRC子集中)这样的细粒度视觉类别,如图1所示。

图1: ILSVRC 2014分类挑战赛的1000类中两个不同的类别。区分这些类别需要领域知识。

网络大小均匀增加的另一个缺点是计算资源的使用急剧增加。例如,在深度视觉网络中,如果将两个卷积层链接起来,它们的滤波器数目的任何均匀增加都会导致计算的二次增长。如果增加的容量没有得到有效的使用(例如,如果大多数权重最终接近于零),那么大量的计算就会被浪费掉。由于计算预算在实践中总是有限的,因此更倾向于有效分配计算资源,而不是任意增加规模,即使主要目标是提高结果的质量。

解决这两个问题的一个基本的方式就是将全连接层替换为稀疏的全连接层,甚至在卷积层内部。除了模仿生物系统之外,由于Arora等人的开创性工作,这也将具有更坚实的理论基础的优势[2]。它们的主要结果是,如果数据集的概率分布可以用一个大的、非常稀疏的深层神经网络来表示, 则最优的网络拓扑结构可以通过分析前一层激活的相关性统计和聚类高度相关的神经元来一层层的构建。尽管严格的数学证明需要很强的条件,但这一说法与众所周知的Hebbian原理产生了共鸣-神经元一起激发、一起连接-这表明,即使在实际中,在不太严格的条件下,这种基本思想也是适用的。

缺点是,今天的计算架构对于非均匀稀疏数据结构的数值计算效率很低。即使算术运算的数量减少了100倍,查找和缓存丢失的开销仍然占主导地位,因此切换到稀疏矩阵是不会有好处的。 随着稳定提升和高度调整的数值库的应用,差距仍在进一步扩大,这些数值库允许极度快速密集的矩阵乘法,利用底层的CPU或GPU硬件[16, 9]的微小细节。此外,非均匀 的稀疏模型需要更复杂的工程和计算基础设施。目前大多数面向视觉的机器学习系统都是利用空间域的稀疏性来实现的。但是,卷积是作为与前一层中的补丁的密集连接的集合来实现的。自[11]以来,为了打破对称性和提高学习能力,卷积网习惯上上在特征维中使用随机和稀疏连接表,以更好地优化并行计算,这种趋势又回到了与[9]完全连接的状态。结构的均匀性和大量的过滤器和更大的批量允许使用高效的密集计算。

这就提出了一个问题:是否有希望实现下一个中间步骤:一种利用额外稀疏性的体系结构,即使是滤波器级,但正如理论所建议的那样,能通过利用密集矩阵上的计算来利用我们当前的硬件。关于稀疏矩阵计算的大量文献(例如[3])表明,将稀疏矩阵聚类成相对稠密的子矩阵,往往会给稀疏矩阵乘法提供最先进的实际性能。似乎不难想象,在不久的将来,类似的方法将被用于非均匀的深度学习体系结构的自动化构建。

Inception架构开始是作为案例研究,用于评估一个复杂网络拓扑构建算法的假设输出,该算法试图近似[2]中所示的视觉网络的稀疏结构,并通过密集的、容易获得的组件来覆盖假设结果。尽管这是一项高度投机性的工作,但只有在对拓扑的精确选择进行了两次迭代之后,我们已经可以看到与基于[12]的参考架构相比所取得的一些进展。在进一步调整学习率、超参数和改进的训练方法之后,我们确定了该Inception结构对于[6]和[5]的基本网络在定位和目标检测方面是特别有用的。有趣的是,虽然大多数最初的架构选择都经过了彻底的质疑和测试,但最终它们至少在本地是最优的。

然而必须谨慎:尽管Inception架构在计算机上领域取得成功,但这是否可以归因于构建其架构的指导原则仍是有疑问的。要确保这一点需要更彻底的分析和验证:例如,如果基于以下原则的自动化工具会发现类似的、但更好的视觉网络拓扑结构。最令人信服的证据是,自动化系统是否会创建网络拓扑,从而在其他领域使用相同的算法,但具有非常不同的全局架构,从而获得类似的收益。至少,Inception架构的最初成功为在这个方向上激动人心的未来工作提供了坚定的动力。

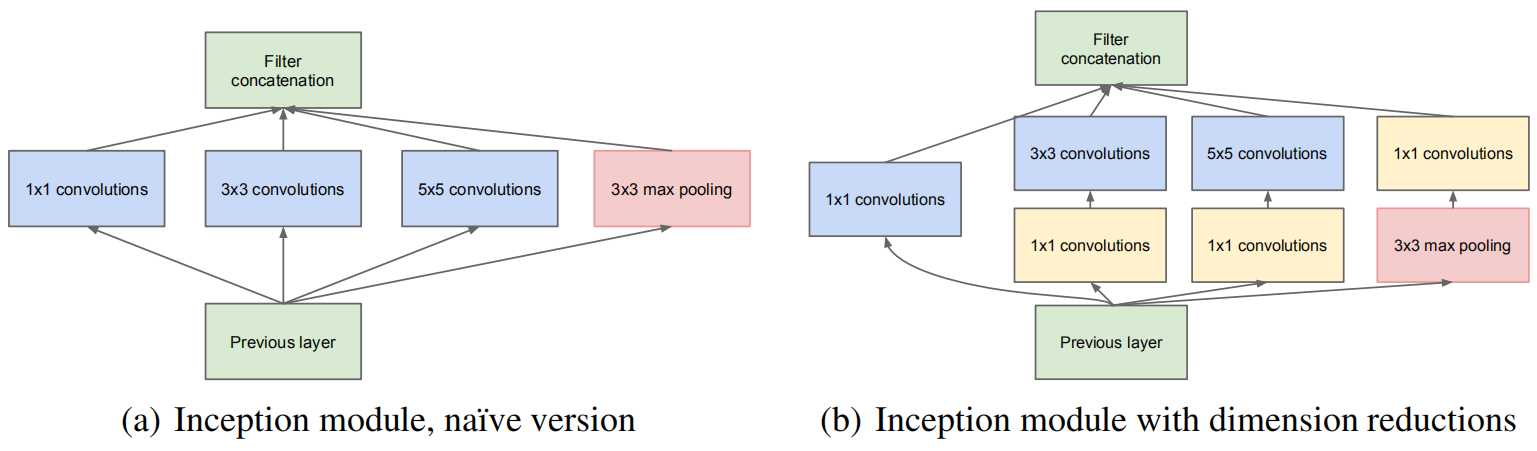

Inception架构的主要思想是找出卷积视觉网络中最优的局部稀疏结构是如何被容易获得的密集分量所近似与覆盖的。请注意,假定转换不变性意味着我们的网络将由卷积积木构建。请注意,假定平移不变性意味着我们的网络将由卷积积木构建。Arora等人[2]提出一种逐层结构,对上一层的相关统计量进行分析,并将其聚成一组具有高度相关性的单元。这些聚类形成了下一层的单元并与前一层的单元连接。我们假设来自前一层的每个单元对应于输入图像的某个区域,并且这些单元被分组为滤波器组。在较低层(接近输入层),相关单元集中在局部区域。这意味着,我们最终会有大量的团簇集中在一个单一的区域,它们可以在下一层被1×1的卷积覆盖,就像[12]中所建议的那样。然而也可以预期,将存在更小数目的在更大空间上扩展的聚类,其可以被更大块上的卷积覆盖,在越来越大的区域上块的数量将会下降。为了避免块校正的问题,目前Inception架构形式的滤波器的尺寸仅限于1×1、3×3、5×5,这个决定更多的是基于便易性而不是必要性。这还意味着所建议的体系结构是所有这些层的组合,它们的输出滤波器组连接成一个单一的输出矢量,形成下一阶段的输入。此外,由于池操作对于当前最先进的卷积网络的成功至关重要,它建议在每个这样的阶段增加一条可供选择的并行池路径,这也应具有额外的有益效果(见图2(A)。

由于这些“Inception模块”是层叠在一起的,它们的输出相关统计量必然会有所不同:由于较高的抽象特征被较高的层所捕捉,它们的空间浓度预计会降低,这意味着3×3和5×5卷积的比率应该随着我们移动到更高的层而增加。

上述模块的一个大问题是在具有大量滤波器的卷积层之上,即使适量的5×5卷积也可能是非常昂贵的,至少在这种朴素形式中有这个问题。一旦将池单元添加到混合中,这个问题就会更加明显:它们的输出过滤器的数量等于上一阶段的过滤器的数量。将池层的输出与卷积层的输出合并将不可避免地导致从一个阶段到另一个阶段的输出数量的增加。即使这个体系结构可能覆盖最优的稀疏结构,它也会非常低效率地完成它,在几个阶段内导致计算崩溃。

这导致了Inception架构的第二个想法:在计算要求会增加太多的地方,明智地减少维度和映射。这是基于嵌入式的成功:即使是低维嵌入也可能包含大量关于相对较大的图像修补程序的信息。然而,嵌入以密集、压缩的形式表示信息,压缩后的信息更难建模。我们希望在大多数地方保持我们的表示稀疏(根据[2]的要求),并且只有当信号必须聚集在一起时才对它们进行压缩。也就是说,在昂贵的3×3和5×5卷积之前,使用1×1卷积来进行计算约简。除了用作减少(参数)外,它们还包括使用经校正的线性激活,使它们具有双重用途。最后的结果如图2(B)所示。

一般来说,Inception网络是由上述类型的模块相互叠加而成的网络,偶尔会有跨越2的最大池层,以将网格的分辨率减半。由于技术原因(训练期间的内存效率),似乎只在较高层开始使用初始模块,而以传统的卷积方式保持较低层的使用是有益的。这不是绝对必要的,只是反映了我们目前实现中的一些基础结构效率低下。

这个体系结构的主要好处之一是,它允许在每个阶段显着地增加单元数量, 而不会在后面的阶段出现计算复杂度不受控制的爆炸。维数约简的普遍使用使得在上一阶段的大量输入滤波器被屏蔽到下一层,首先减小它们的维数,然后再将它们与大的块大小集合在一起。该设计的另一个实际有用的方面是,它与直觉保持一致,即视觉信息应该在不同的尺度上进行处理,然后进行聚合,以便下一阶段能够同时从不同的尺度中提取特征。

通过改进计算资源的使用,可以增加每个阶段的宽度和阶段数,而不会陷入计算困难。另一种利用初始架构的方法是创建稍微低劣的,但计算成本较低的版本。我们已经发现,所有包含的旋钮和杠杆都允许对计算资源进行控制平衡,从而使网络比具有非初始架构的类似执行网络快2−3×,但是这需要在此时进行仔细的手工设计。

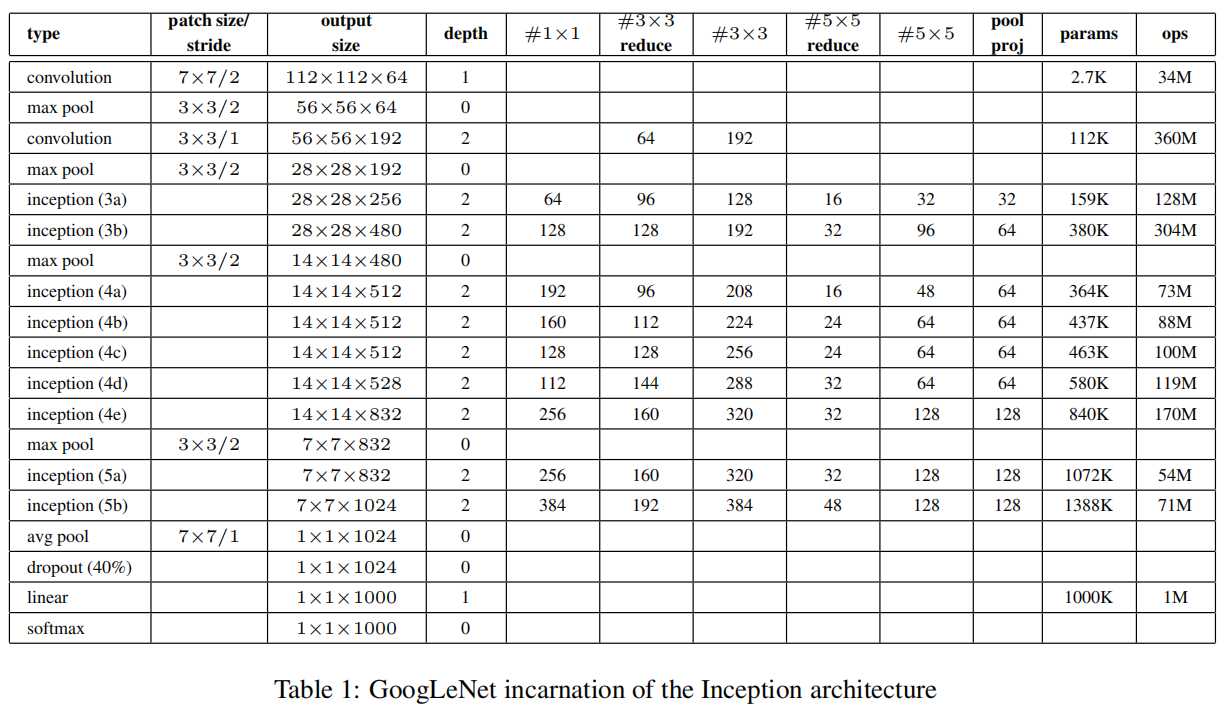

我们在ilsvrc 14竞赛中选择GoogLeNet作为我们的团队名称。这个名字是对亚恩莱昂开拓性的 LeNet 55网络[10]的一种敬意。我们还使用GoogleNet来作为我们提交的竞赛中所使用的Inception架构的特例。我们还使用了一个更深更广的初始网络,其质量稍差,但将其添加到集合中似乎可以稍微提高效果。我们忽略了网络的细节,因为我们的实验表明,精确的架构参数的影响相对较小。在这里,为了演示目的,表1描述了最成功的特定实例(名为GoogLeNet)。在我们集成的7种模型中,有6种采用了完全相同的拓扑结构(用不同的采样方法训练)。

所有的卷积都使用了修正线性激活,包括Inception模块内部的卷积。在我们的网络中感受野是在均值为0的RGB颜色空间中,大小是224×224。“#3×3 reduce”和“#5×5 reduce”表示在3×3和5×5卷积之前,降维层使用的1×1滤波器的数量。在pool proj列可以看到内置的最大池化之后,投影层中1×1滤波器的数量。所有的这些降维/投影层也都使用了线性修正激活。

该网络的设计考虑了计算效率和实用性,因此可以在单个设备上运行,包括那些计算资源有限的设备,尤其是内存占用较少的设备。当只计算带有参数的层时,网络有22层深度(如果计算pooling 池,则为27层)。用于建造网络的层(独立构建块)的总数约为100层。然而,这个数字取决于所使用的机器学习基础设施系统。在分类器之前使用平均池是基于[12]的,尽管我们的实现不同之处在于我们使用了额外的线性层。 线性层使我们的网络能很容易地适应其它的标签集,但它主要是方便,我们不期望它有一个重大的影响。我们发现从全连接层变为平均池化,提高了大约top-1 %0.6的准确率,然而即使在移除了全连接层之后,Dropout的使用还是必不可少的。

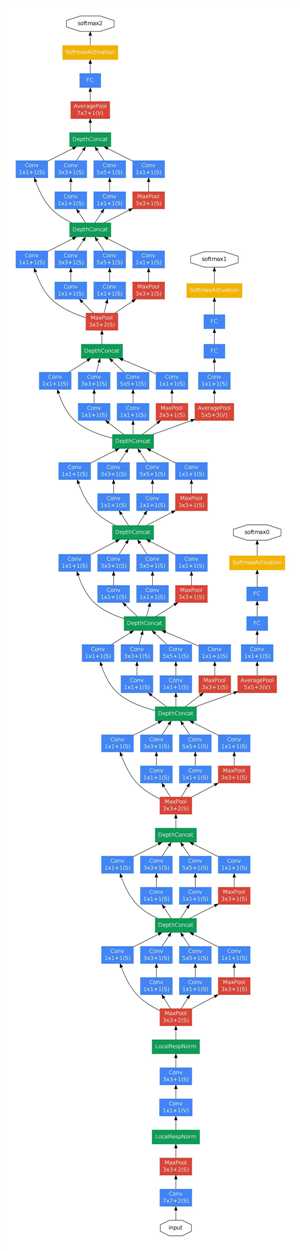

考虑到网络的相对较大的深度,以有效的方式将梯度传播回所有层的能力是一个值得关注的问题。一个有趣的观点是,相对较浅的网络在这项任务上的强大性能表明,网络中间层产生的特性应该是非常有区别的。通过增加与这些中间层相连接的辅助分类器,我们期望在分类器的较低阶段增强识别,增加传播回来的梯度信号,并提供额外的正则化。这些分类器采用设置在初始(4a)和(4d)模块的输出之上的较小卷积网络的形式。在训练过程中,它们的损失以折扣权重加到网络的总损失中(辅助分类器的损失加权0.3)。在推理时,这些辅助网络被丢弃。

包括辅助分类器在内的附加网络的具体结构如下:

一个滤波器大小5×5,步长为3的平均池化层,导致(4a)阶段的输出为4×4×512,(4d)的输出为4×4×528。

具有128个滤波器的1×1卷积,用于降维和修正线性激活。

一个全连接层,具有1024个单元和修正线性激活。

丢弃70%输出的丢弃层。

使用带有softmax损失的线性层作为分类器(作为主分类器预测同样的1000类,但在推断时移除)。

我们的网络使用分布式机器学习系统对网络进行了训练,使用了少量的模型和数据并行性。尽管我们仅使用一个基于CPU的实现,但粗略的估计表明GoogLeNet网络可以用更少的高端GPU在一周之内训练到收敛,主要的限制是内存使用。我们的训练采用异步随机梯度下降的0.9动量[17],固定的学习速率时间表(降低4%的学习率每8个时代)。利用Polyak平均[13]建立了推理时使用的最终模型。

图像采样方法在过去几个月的竞赛中发生了重大变化,并且已收敛的模型(可以)在其他选项上进行了训练,有时还结合着超参数的改变,例如丢弃和学习率,因此,很难对培训这些网络的最有效的单一方式给予明确的指导。使问题更加复杂的是,一些模型主要是在较小的相对裁剪(crop)上进行训练,另一些是在[8]的启发下训练更大的crop。不过,有一种处方在比赛后得到了很好的验证,它的尺寸均匀分布在图像区域的8%—100%之间,并在3/4和4/3之间随机选择其长宽比的各种大小的图像块进行采样。此外,我们还发现,AndrewHoward[8]的光度畸变在一定程度上有助于防止过度拟合。此外,我们还开始使用随机插值方法(双线性、面积、最近邻和立方,概率相等)来比较晚地调整大小,并结合其他超参数变化,因此无法确定最终结果是否受到其使用的积极影响。

ILSVRC 2014分类挑战涉及将图像分类为ImageNet层次结构中的1000个叶节点类别之一的任务。大约有120万张图像用于培训,5万张用于验证,10万张用于测试。每幅图像都与一个地面真相分类器相关联,并且性能是基于最高得分分类器预测来衡量的。通常报告两个数字:top-1准确率,比较实际类别和第一个预测类别,top-5错误率,比较实际类别与前5个预测类别:如果图像实际类别在top-5中,则认为图像分类正确,不管它在top-5中的排名。挑战赛使用top-5错误率来进行排名。

我们参加了这次挑战,没有使用外部数据进行培训。除了本文中提到的训练技术之外,我们还在测试中采用了一套技术来获得更高的性能,我们将在下面对此进行详细的阐述。

我们独立地培训了7个版本的相同的谷歌网模型(包括一个更广泛的版本),并与他们一起进行了集成预测。这些模型经过相同的初始化(甚至具有相同的初始权重(主要是由于疏忽)和学习速率策略的训练,它们只在采样方法和看到输入图像的随机顺序上有所不同。

在测试中,我们采用比Krizhevsky等人[9]更积极的裁剪方法。具体来说,我们将图像归一化为四个尺度,其中较短维度(高度或宽度)分别为256,288,320和352,取这些归一化的图像的左,中,右方块(在肖像图片中,我们采用顶部,中心和底部方块)。对于每个方块,我们将采用4个角以及中心224×224裁剪图像以及方块尺寸归一化为224×224,以及它们的镜像版本。这导致每张图像会得到4×3×6×2 = 144的裁剪图像。前一年的输入中,Andrew Howard[8]采用了类似的方法,经过我们实证验证,其方法略差于我们提出的方案。我们注意到,在实际应用中,这种积极裁剪可能是不必要的,因为存在合理数量的裁剪图像后,更多裁剪图像的好处会变得很微小(正如我们后面展示的那样)。

在多个作物和所有分类器上,对Softmax概率进行平均,以获得最终的预测结果。在我们的实验中,我们分析了验证数据的替代方法,例如对裁剪的最大池和对分类器的平均,但它们导致的性能不如简单平均。

在本文的其余部分,我们分析了影响最终提交的总体性能的多种因素。

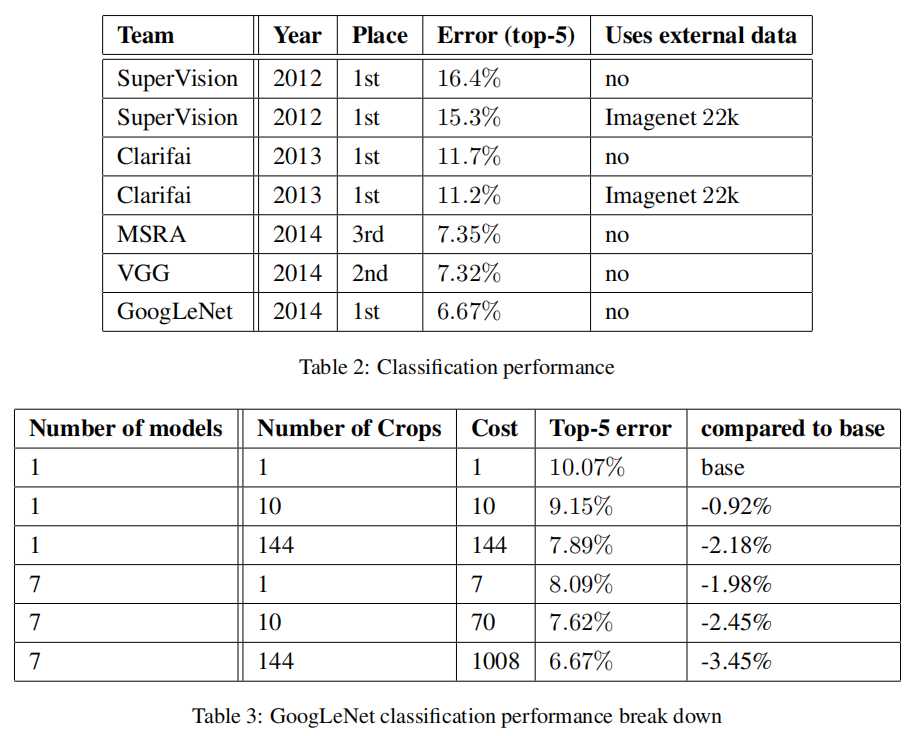

我们在挑战中的最后提交在验证和测试数据上都获得了6.67%的前5位错误,在其他参与者中排名第一。这与2012年的监督方法相比,相对减少了56.5%,与前一年的最佳方法(Clarifai)相比,相对减少了40%,这两种方法都使用外部数据来培训分类器。下表显示了一些性能最好的方法的统计数据。

我们还通过改变模型的数量和在下表中预测图像时使用的作物数量来分析和报告多种测试选择的性能。当我们使用一个模型时,我们选择了一个在验证数据上具有最低前1错误率的模型。所有数字 都报告在验证数据集中,以避免与测试数据统计数据过分匹配。

ILSVRC检测任务是在200个可能的类中,围绕图像中的对象生成包围框。如果检测到的对象与地面真相类相匹配,并且它们的边界框至少重叠50%(使用Jaccard索引),则它们就算作正确的对象。多余的检测被视为假阳性并受到惩罚。与分类任务相反,每幅图像可能包含多个对象,也可能没有对象,它们的比例可能从大到小。报告的结果使用平均精度均值(mAP)。

Google网所采用的检测方法与r-CNN的方法类似[6],但作为区域分类器的起始模型得到了扩展。此外,通过将选择性搜索[20]方法与多框[5]预测相结合,改进了区域建议步骤,从而提高了目标包围盒召回率。为了减少假阳性的数量,增加了2倍的超像素大小。这将选择性搜索算法中的提议减半。我们总共补充了200个来自多盒结果的区域生成,大约60%的区域生成用于[6],同时将覆盖率从92%提高到93%。减少区域生成的数量,增加覆盖率的整体影响是对于单个模型的情况平均精度均值增加了1%。最后,等分类单个区域时,我们使用了6个GoogLeNets的组合。这导致准确率从40%提高到43.9%。注意,与R-CNN相反,由于缺少时间我们没有使用边界框回归。

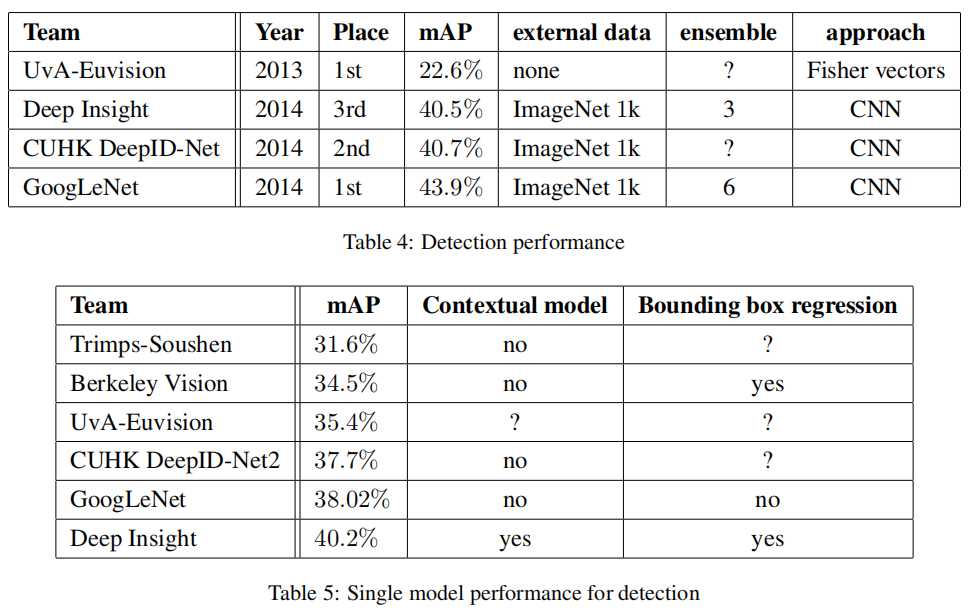

我们首先报告顶级检测结果,并显示自第一版检测任务以来的进展情况。与2013年的结果相比,准确率几乎翻了一番。表现最好的团队都使用卷积网络。我们报告表4中的官方分数和每个团队的共同策略:使用外部数据、集成模型或上下文模型。外部数据通常是用于预训练的ilsvrc 12分类数据,该模型随后对检测数据进行细化。一些团队还提到了本地化数据的使用。由于定位任务边界框的很大一部分不包含在检测数据集中,因此可以使用该数据对一个通用的边界盒回归器进行预训练,就像在预训练中使用分类一样。

在表5中,我们仅比较了单个模型的结果。最好性能模型是Deep Insight的,令人惊讶的是3个模型的集合仅提高了0.3个点,而GoogLeNet在模型集成时明显获得了更好的结果。

我们的结果似乎提供了一个确凿的证据,证明用现有的密集积木来逼近预期的最优稀疏结构是改进计算机视觉神经网络的一种可行方法。该方法的主要优点是与较浅和较小的网络相比,在计算需求略有增加的情况下获得了显著的质量增益。还要注意的是,我们的检测工作是有竞争力的,尽管既没有使用上下文,也没有执行边界框回归,这一事实为初始架构的强度提供了进一步的证据。虽然我们的方法可以通过更昂贵的、深度和宽度相似的网络来实现类似的结果质量,但是我们的方法提供了确凿的证据,证明移动到稀疏的体系结构在一般情况下是可行的和有用的。这表明未来有希望在[2]的基础上,以自动化的方式创造更稀疏、更精细的结构。

我们要感谢Sanjeev Arora和Aditya Bhas卡拉就[2]进行的富有成果的讨论。我们还要感谢迪贝利夫[4]队的支持,特别是对拉贾特·蒙加、乔恩·希透镜、亚历克斯·克里泽夫斯基、杰夫·迪安、伊利亚·萨茨卡特和安德里亚·弗洛姆的支持。我们还要感谢汤姆·杜里格和宁·叶在光度畸变方面的帮助。此外,如果没有查克、罗森博格和哈特尼格·亚当的支持,我们的工作就不可能完成。

[1] Know your meme: We need to go deeper. http://knowyourmeme.com/memes/we-need-to-go-deeper. Accessed: 2014-09-15.

[2] S. Arora, A. Bhaskara, R. Ge, and T. Ma. Provable bounds for learning some deep representations. CoRR, abs/1310.6343, 2013.

[3] U. V. C ?atalyu ?rek, C. Aykanat, and B. Uc ?ar. On two-dimensional sparse matrix partitioning: Models, methods, and a recipe. SIAM J. Sci. Comput., 32(2):656–683, Feb. 2010.

[4] J. Dean, G. Corrado, R. Monga, K. Chen, M. Devin, M. Mao, M. Ranzato, A. Senior, P. Tucker, K. Yang, Q. V. Le, and A. Y. Ng. Large scale distributed deep networks. In P. Bartlett, F. Pereira, C. Burges, L. Bottou, and K. Weinberger, editors, NIPS, pages 1232–1240. 2012.

[5] D. Erhan, C. Szegedy, A. Toshev, and D. Anguelov. Scalable object detection using deep neural networks. In CVPR, 2014.

[6] R. B. Girshick, J. Donahue, T. Darrell, and J. Malik. Rich feature hierarchies for accurate object detection and semantic segmentation. In Computer Vision and Pattern Recognition, 2014. CVPR 2014. IEEE Conference on, 2014.

[7] G. E. Hinton, N. Srivastava, A. Krizhevsky, I. Sutskever, and R. Salakhutdinov. Improving neural networks by preventing co-adaptation of feature detectors. CoRR, abs/1207.0580, 2012.

[8] A. G. Howard. Some improvements on deep convolutional neural network based image classification. CoRR, abs/1312.5402, 2013.

[9] A. Krizhevsky, I. Sutskever, and G. Hinton. Imagenet classification with deep convolutional neural networks. In Advances in Neural Information Processing Systems 25, pages 1106–1114, 2012.

[10] Y. LeCun, B. Boser, J. S. Denker, D. Henderson, R. E. Howard, W. Hubbard, and L. D. Jackel. Backpropagation applied to handwritten zip code recognition. Neural Comput., 1(4):541–551, Dec. 1989.

[11] Y. LeCun, L. Bottou, Y. Bengio, and P. Haffner. Gradient-based learning applied to document recognition. Proceedings of the IEEE, 86(11):2278–2324, 1998.

[12] M. Lin, Q. Chen, and S. Yan. Network in network. CoRR, abs/1312.4400, 2013.

[13] B. T. Polyak and A. B. Juditsky. Acceleration of stochastic approximation by averaging. SIAM J. Control Optim., 30(4):838–855, July 1992.

[14] P. Sermanet, D. Eigen, X. Zhang, M. Mathieu, R. Fergus, and Y. LeCun. Overfeat: Integrated recognition, localization and detection using convolutional networks. CoRR, abs/1312.6229, 2013.

[15] T. Serre, L. Wolf, S. M. Bileschi, M. Riesenhuber, and T. Poggio. Robust object recognition with cortex-like mechanisms. IEEE Trans. Pattern Anal. Mach. Intell., 29(3):411–426, 2007.

[16] F. Song and J. Dongarra. Scaling up matrix computations on shared-memory manycore systems with 1000 cpu cores. In Proceedings of the 28th ACM Interna- tional Conference on Supercomputing, ICS ’14, pages 333–342, New York, NY, USA, 2014. ACM.

[17] I. Sutskever, J. Martens, G. E. Dahl, and G. E. Hinton. On the importance of initialization and momentum in deep learning. In ICML, volume 28 of JMLR Proceed- ings, pages 1139–1147. JMLR.org, 2013.

[18] C.Szegedy,A.Toshev,andD.Erhan.Deep neural networks for object detection. In C. J. C. Burges, L. Bottou, Z. Ghahramani, and K. Q. Weinberger, editors, NIPS, pages 2553–2561, 2013.

[19] A. Toshev and C. Szegedy. Deeppose: Human pose estimation via deep neural networks. CoRR, abs/1312.4659, 2013.

[20] K. E. A. van de Sande, J. R. R. Uijlings, T. Gevers, and A. W. M. Smeulders. Segmentation as selective search for object recognition. In Proceedings of the 2011 International Conference on Computer Vision, ICCV ’11, pages 1879–1886, Washington, DC, USA, 2011. IEEE Computer Society.

[21] M. D. Zeiler and R. Fergus. Visualizing and understanding convolutional networks. In D. J. Fleet, T. Pajdla, B. Schiele, and T. Tuytelaars, editors, ECCV, volume 8689 of Lecture Notes in Computer Science, pages 818–833. Springer, 2014.

Going deeper with convolutions——Googlenet论文翻译

标签:mes 滤波器 时代 直接 使用外部 man 占用 利用 google

原文地址:https://www.cnblogs.com/baby-lily/p/12609397.html