标签:blog 变化 重要 特征 rnn 共享 传递 神经元 卷积

DNN,CNN,RNN:

1.DNN:深度神经网络,或称多层感知机。解决早期单层感知机对于复杂函数不能模拟的情况。其形式为层之间全连接。实用sig等连续性函数模拟神经对机理的响应,训练算法使用 BP。

2.问题:只是名义上的深层。

a:随着层数的加深,优化函数更加容易陷入局部最优解。并且会越来越偏离

b:梯度消失情况更加严重。每传递一层,梯度衰减为原来的0.25;

c:多层全连接导致参数膨胀;

当时解决方法:

a:实用预训练方法缓解最优解。

b:为客服梯度消失,实用relu,maxou等传输函数代替sigMoid;

3.CNN:不是所有上下层神经元都能直接相连,而是通过“卷积核”作为中介。同一个卷积核在所有图像内是共享的,图像通过卷积操作后仍然保留原先的位置关系.对于一个图像分别 用多个卷积核进行描述,每个卷积核学习到不提不同的结构特征。最后一层是全连接层。

4.RNN:可以对变化的时间序列进行建模。对于自然语言处理,语音识别,手写体识别非常重要。

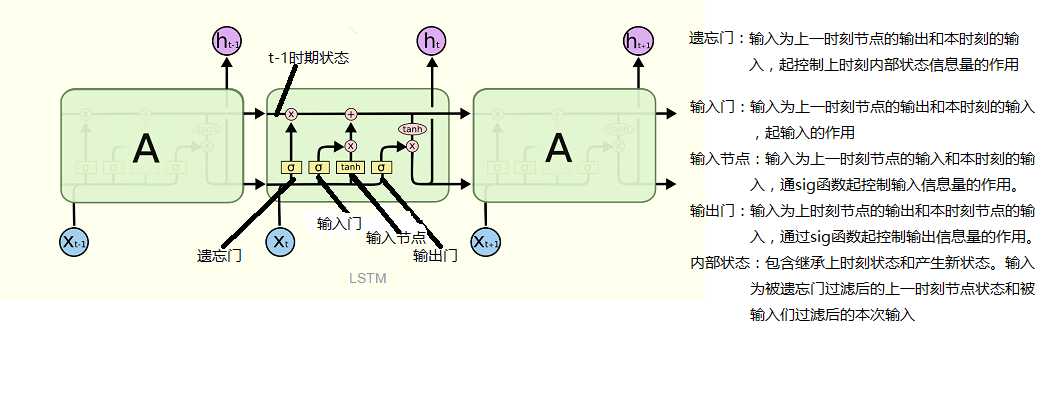

5.LSTM隐含层示例:

标签:blog 变化 重要 特征 rnn 共享 传递 神经元 卷积

原文地址:http://www.cnblogs.com/zjh225901/p/6611656.html