标签:实例 name tps 登录 生成 targe cut 运行 ber

在采集美女站时,需要对关键词进行分词,最终采用的是python的结巴分词方法.

中文分词是中文文本处理的一个基础性工作,结巴分词利用进行中文分词。其基本实现原理有三点:

安装(Linux环境)

下载工具包,解压后进入目录下,运行:python setup.py install

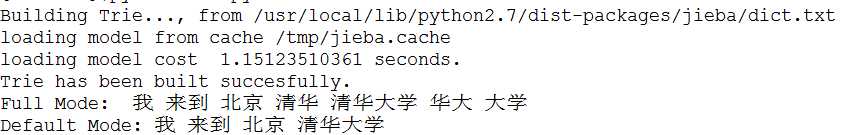

模式

接口

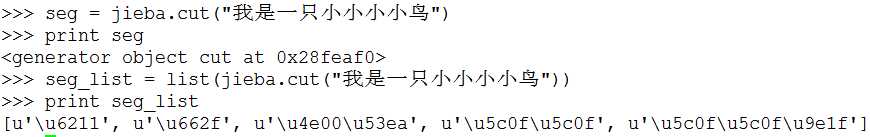

实例

#! -*- coding:utf-8 -*-

import jieba

seg_list = jieba.cut("我来到北京清华大学", cut_all = True)

print "Full Mode:", ‘ ‘.join(seg_list)

seg_list = jieba.cut("我来到北京清华大学")

print "Default Mode:", ‘ ‘.join(seg_list)

结果

标签:实例 name tps 登录 生成 targe cut 运行 ber

原文地址:http://www.cnblogs.com/pyxiaomangshe/p/7830886.html