标签:深度网络 总结 mamicode 输出 深度 视觉 高斯 数加 基本知识

摘录自《机器学习及应用》汪荣贵 机械工业出版社

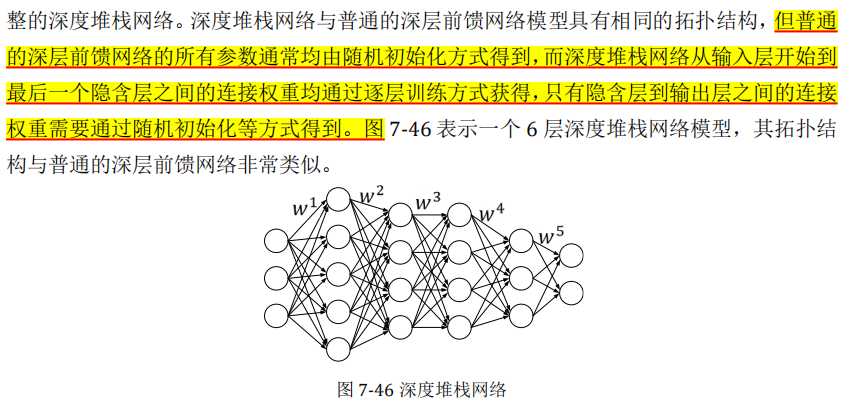

总结了一些神经网络与深度学习中的一些网络介绍。

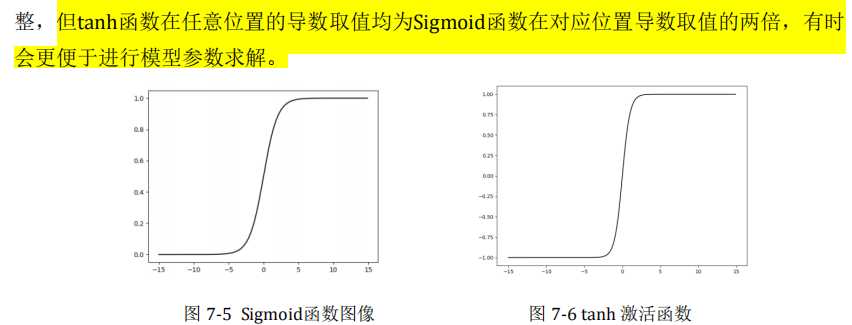

(1)关于激活函数

(2)MLP

2.1 前馈神经网络:径向基网络和自编码网络。

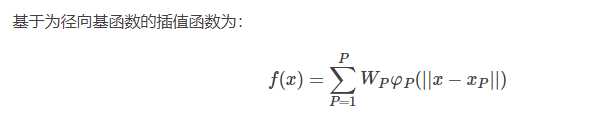

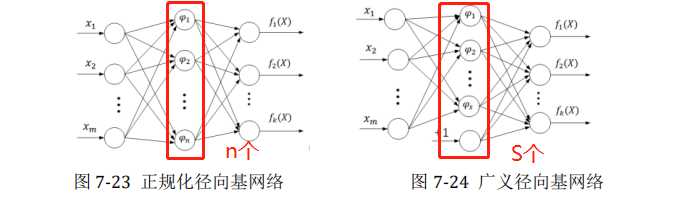

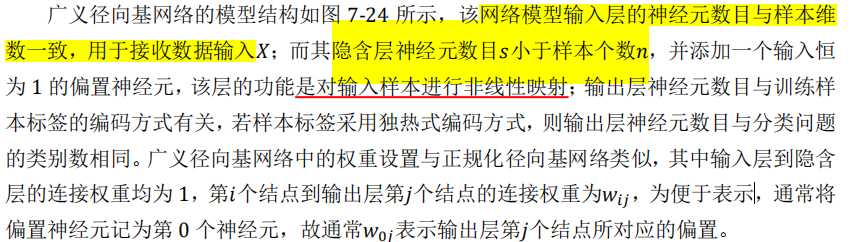

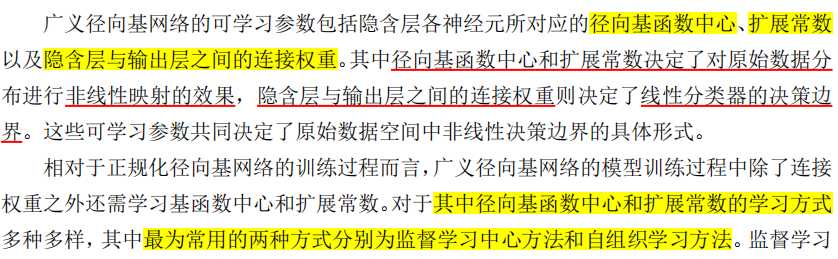

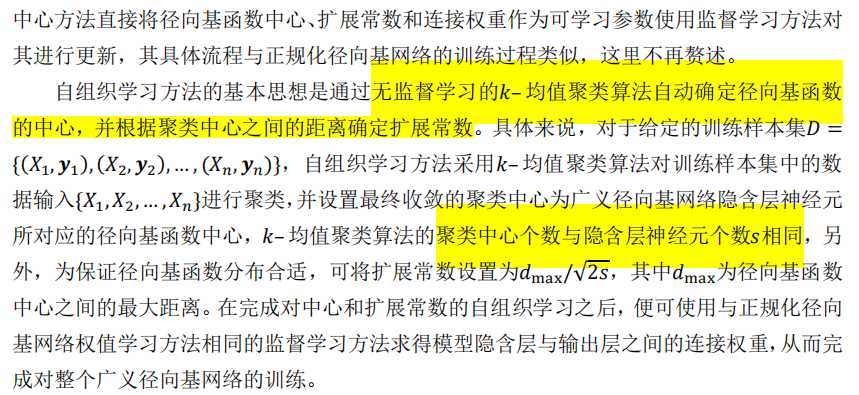

径向基函数的自变量是距离。有很多可供选择的径向基函数:高斯径向基函数,反演S径向基函数等。正规化径向基网络的输入层结点数目与样本维数相同,用于接收数据输入??;隐含层结点数目与样本个数相同,并且这些神经元的激活函数均采用径向基函数;输出层结点将隐含层的处理结果进行加权求和得到输出向量。由于正规化径向基网络参数多,难以训练,且隐藏层的神经元仅用来非线性映射,并不用来拟合,故可减少神经元的个数,降低复杂度的同时又不会影响非线性可分的分类问题的效果,通过减少神经元出现的径向基网络称之为广义径向基网络。

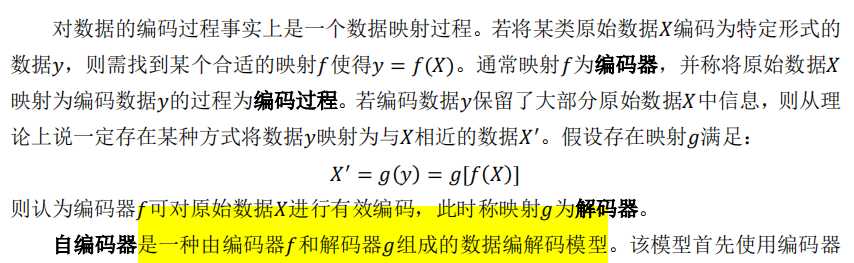

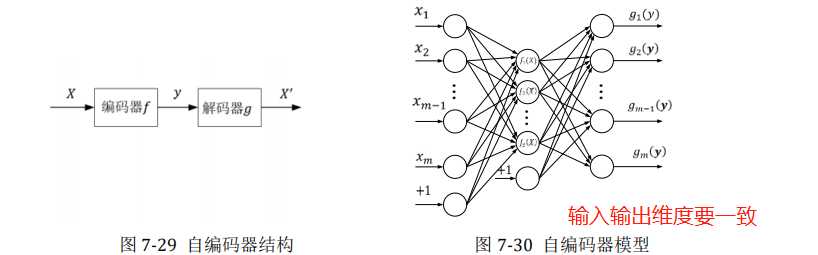

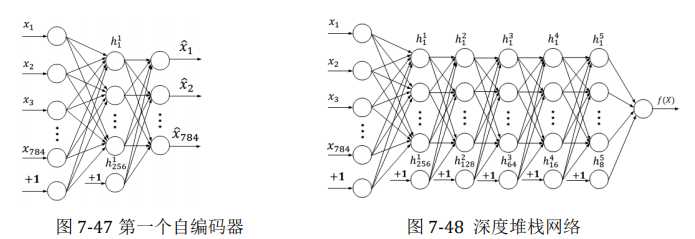

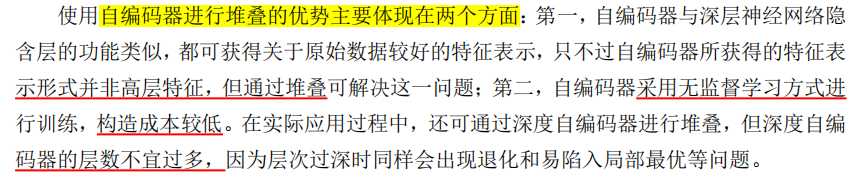

(2)自编码器:能实现自编码器的神经网络。

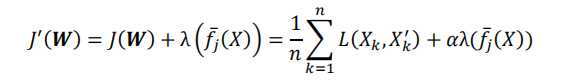

自编码器隐含层的结点数目主要取决于具体问题的特点和需要,通常将隐含层的偏置结点记为该隐含层的第0个结点。自编码器的模型训练通常使用不带标注信息的示例样本,故是一种无监督学习方式。若自编码器隐含层神经元数目s大于输入数据维度m即可实现升维,即稀疏编码。稀疏编码的目标函数:

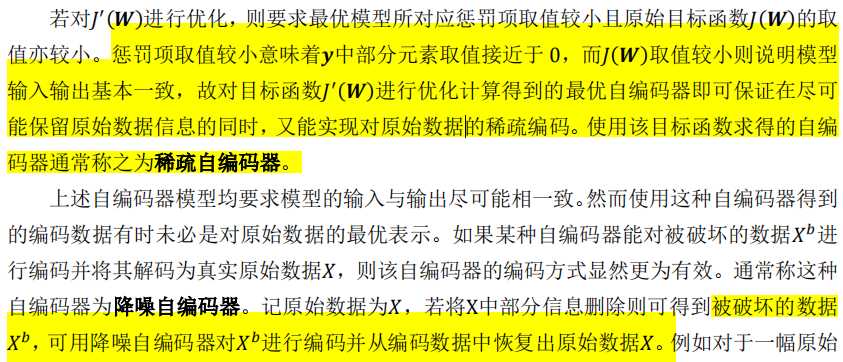

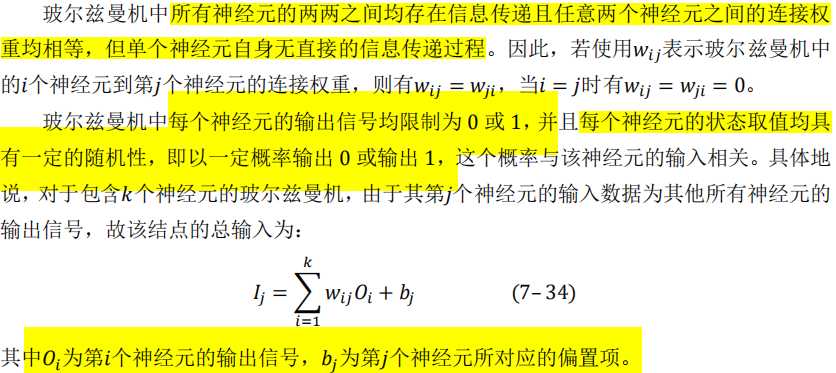

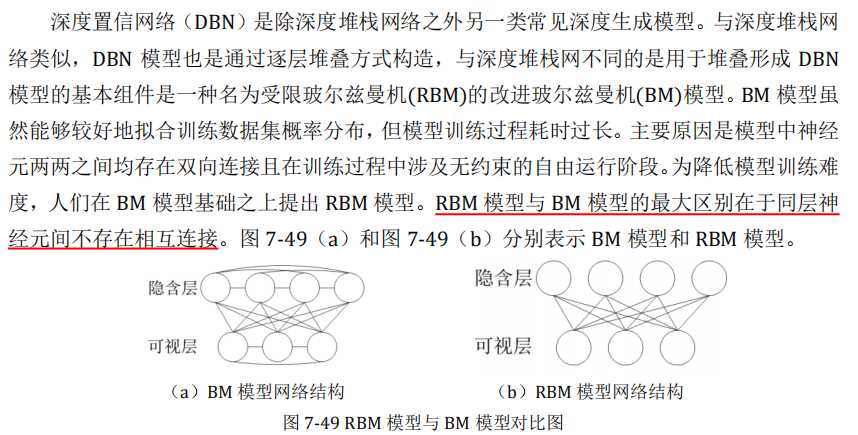

2.2 反馈神经网络: 玻尔兹曼机

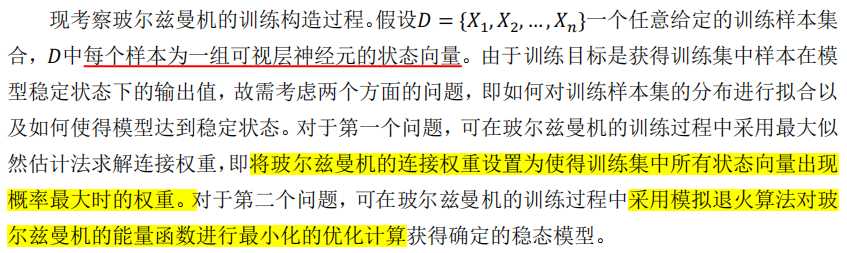

3.2 深度置信网络(DBN)

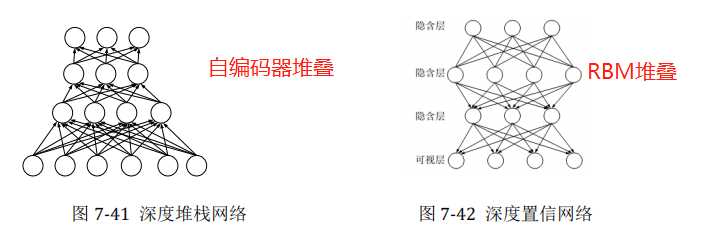

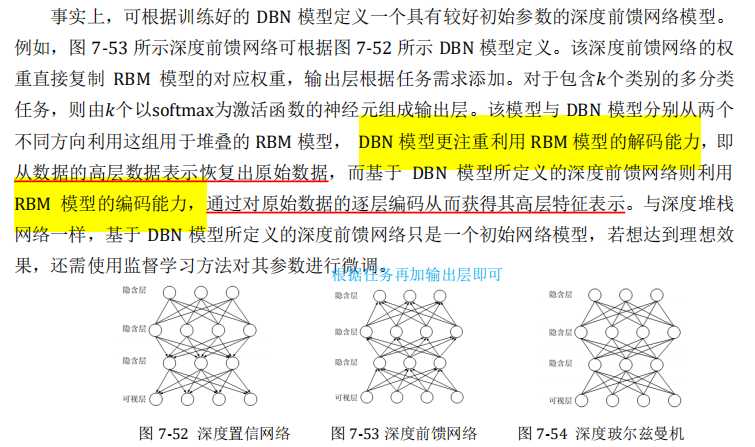

事实上,可将深度堆栈网络看成是深度置信网络的一种改进。对于DBN 而言,人们更倾向于利用该模型定义一个具有较优初始权重的深度前馈网络从而解决某些预测性问题,而非用于生成新样本。但RBM的训练过程较为麻烦,改用自编码器作为堆叠组件可降低模型训练难度并保证所构造的深度前馈网络也具有较优的初始权重。

目前使用更为广泛的深度生成模型为生成对抗网络,该模型以判别模块来强迫生成模块产生与真实数据分布相近的样本,当判别模块再也无法判断一个数据是真实样本还是生成样本时,即可认为生成对抗网络的生成模块达到最佳状态,此时使用该模块所生成的样本应最接近于数据的真实分布。

ps:由于方便,截图呈现,具体内容请参见原书,或查阅相关资料。

神经网络与深度学习——《机器学习及应用》汪荣贵 机械工业出版社

标签:深度网络 总结 mamicode 输出 深度 视觉 高斯 数加 基本知识

原文地址:https://www.cnblogs.com/DHuifang004/p/11415326.html