标签:mic 方法 orm 技术 app 神经网络 content art access

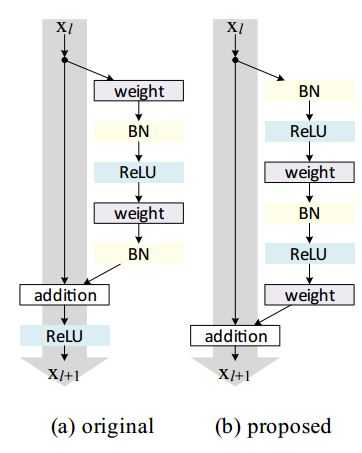

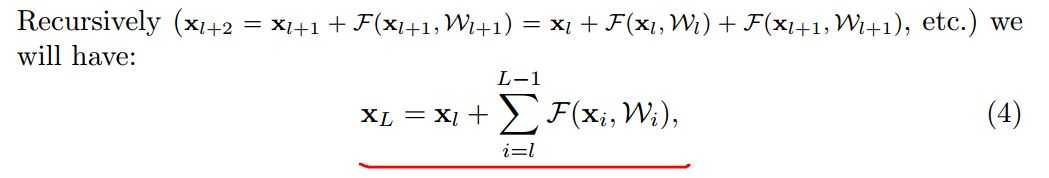

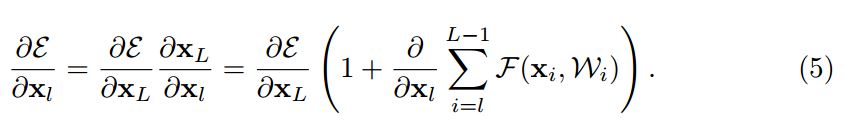

residual着重要解决网络加深带来的模型退化问题(degradation)。

思路很简单,浅层的网络性能比深层网络性能好,这样如果我仅仅是用 等变映射(Identity Mapping)去加深网络,那么网络的性能肯定不会比浅层的差。

)

2019/11/21 Residual Learning论文学习

标签:mic 方法 orm 技术 app 神经网络 content art access

原文地址:https://www.cnblogs.com/Research-XiaoEMo/p/11922359.html