标签:转换 类别 als 分类算法 imp tps def report 金融

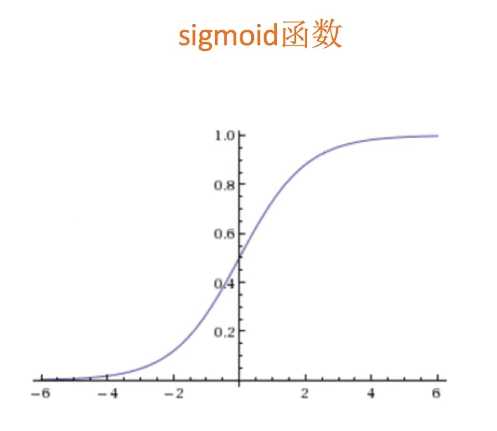

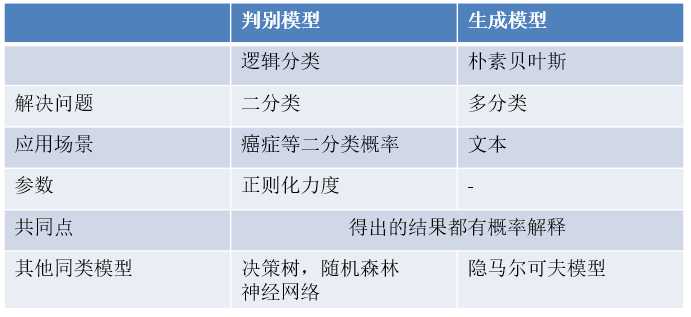

sigmoid函数:1/(1+e^-x), 将输入值x,映射到(0,1), 与概率值联系起来

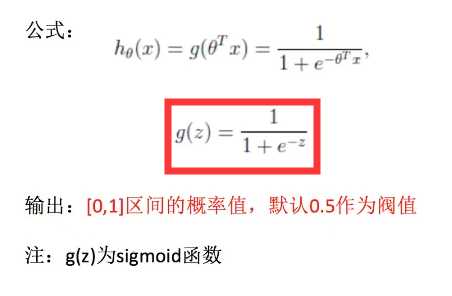

逻辑回归公式

线性回归的输入 --> sigmoid 转换 -->分类 [0,1] 概率值, 阈值一般取0.5

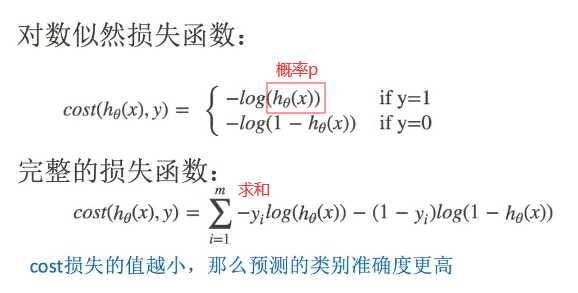

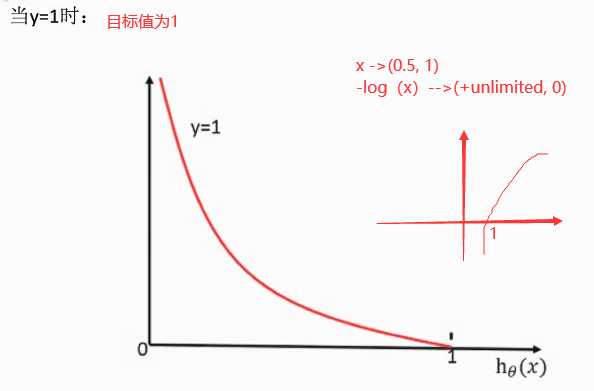

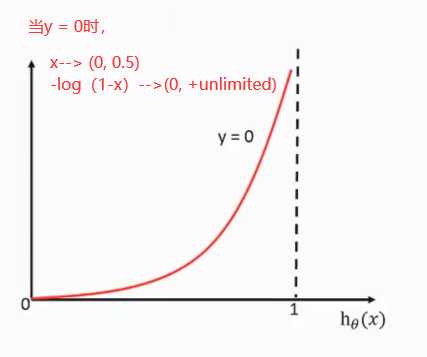

y =1, 目标值为1 ,预测值为1的概率是100%, 则损失最小(接近0)

注: 哪一类别数据量小,则哪一种特征为正例1

目标值是0类,预测1类的概率越大,则损失越大。(预测属于0的概率越大越好)

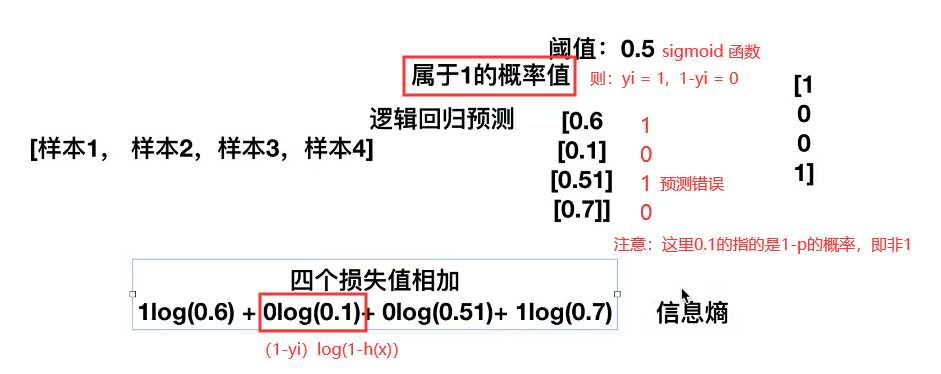

只判断属于一个类别的概率,这里是属于1的概率,如果属于1的概率较小(小于阈值),则非1,即为0。

良/恶性乳腺癌数据

原始数据的下载地址:

https://archive.ics.uci.edu/ml/machine-learning-databases/

数据描述

(1)699条样本,共11列数据,第一列用语检索的id,后9列分别是与肿瘤

相关的医学特征,最后一列表示肿瘤类型的数值。

(2)包含16个缺失值,用”?”标出。

from sklearn.linear_model import LinearRegression, SGDRegressor, Ridge, LogisticRegression

from sklearn.model_selection import train_test_split

from sklearn.preprocessing import StandardScaler

from sklearn.metrics import mean_squared_error, classification_report

from sklearn.externals import joblib

import pandas as pd

import numpy as np

def logistic():

"""

逻辑回归做二分类癌症预测

:return: None

"""

# 1.读取数据

# 构造列标签名字

column = ['Sample code number','Clump Thickness', 'Uniformity of Cell Size','Uniformity of Cell Shape','Marginal Adhesion','Single Epithelial Cell Size','Bare Nuclei','Bland Chromatin','Normal Nucleoli','Mitoses','Class']

data = pd.read_csv('https://archive.ics.uci.edu/ml/machine-learning-databases/breast-cancer-wisconsin/breast-cancer-wisconsin.data', names=column)

print(data)

# 2.缺失值处理

data = data.replace(to_replace='?', value=np.nan)

data = data.dropna() # 直接删除nan

# 3. 进行数据分割

x_train, x_test, y_train, y_test = train_test_split(data[column[1:10]], data[column[10]], test_size=0.25) # 取特征值,目标值

# 4.标准化处理 (分类问题,目标值不做标准化)

std = StandardScaler()

x_train = std.fit_transform(x_train)

x_test = std.transform(x_test)

# 5. 逻辑回归预测

lg = LogisticRegression(C=1.0)

lg.fit(x_train, y_train) # 训练lg模型

print(lg.coef_)

y_predict = lg.predict(x_test)

print('准确率:', lg.score(x_test, y_test))

print('召回率:',classification_report(y_test, y_predict, labels=[2,4], target_names=['良性','恶性']))

if __name__ == '__main__':

logistic()

标签:转换 类别 als 分类算法 imp tps def report 金融

原文地址:https://www.cnblogs.com/hp-lake/p/11979505.html