标签:匹配 同步 自己 关闭selinux tin bash war 静态方法 路由器

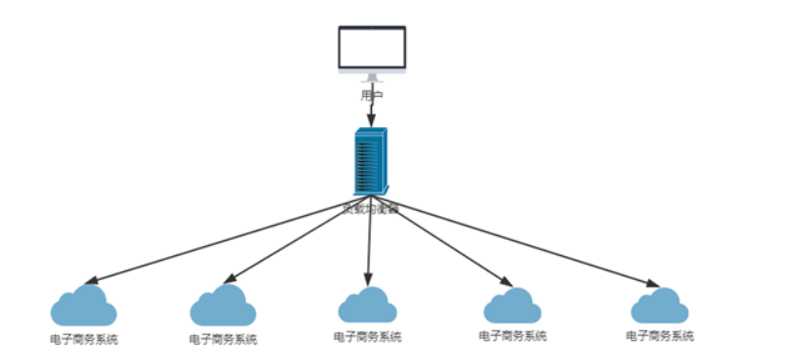

1 集群(cluster)技术是一种较新的技术,通过集群技术,可以在付出较低成本的情况下获得在性能、可靠性、灵活性方面的相对较高的收益,其任务调度则是集群系统中的核心技术。

2 集群组成后,可以利用多个计算机和组合进行海量请求处理(负载均衡),从而获得很高的处理效率,也可以用多个计算机做备份(高可用),使得任何一个机器坏了整个系统还是能正常运行。

① 负载均衡(Load Balance):负载均衡集群为企业需求提供了可解决容量问题的有效方案。负载均衡集群使负载可以在计算机集群中尽可能平均地分摊处理。

② 负载通常包括应用程序处理负载和网络流量负载,每个节点都可以承担一定的处理负载,并且可以实现处理负载在节点之间的动态分配,以实现负载均衡。

负载均衡(Load Balance)

负载均衡技术类型:基于 4 层负载均衡技术和基于 7 层负载均衡技术

负载均衡实现方式:硬件负载均衡设备或者软件负载均衡

硬件负载均衡产品:F5 、深信服 、Radware

软件负载均衡产品: LVS(Linux Virtual Server)、 Haproxy、Nginx、Ats(apache traffic server)

我们先来看一张图,相信很多同学对这张图都不陌生,这是一张网络模型图,包含了 OSI 模型及 TCP/IP 模型,两个模型虽然有一点点区别,但主要的目的是一样的,模型图描述了通信是怎么进行的。它解决了实现有效通信所需要的所有过程,并将这些过程划分为逻辑上的层。层可以简单地理解成数据通信需要的步骤。

负载均衡根据所采用的设备对象(软/硬件负载均衡),应用的OSI网络层次(网络层次上的负载均衡),及应用的地理结构(本地/全局负载均衡)等来分类。下面着重介绍的是根据应用的 OSI 网络层次来分类的两个负载均衡类型。

负载均衡可以大概分为以下几类:

二层负载均衡(mac)

一般是用虚拟mac地址方式,外部对虚拟MAC地址请求,负载均衡接收后分配后端实际的MAC地址响应。

三层负载均衡(ip)

一般采用虚拟IP地址方式,外部对虚拟的ip地址请求,负载均衡接收后分配后端实际的IP地址响应。

四层负载均衡(tcp)

在三层负载均衡的基础上,用ip+port接收请求,再转发到对应的机器。

七层负载均衡(http)

根据虚拟的url或IP,主机名接收请求,再转向相应的处理服务器。

在实际应用中,比较常见的就是四层负载及七层负载。这里也重点说下这两种负载。

实现四层负载均衡的软件有:

| 四层负载均衡 | 七层负载均衡 | |

|---|---|---|

| 基于 | 基于IP+Port的 | 基于虚拟的URL或主机IP等。 |

| 类似于 | 路由器 | 代理服务器 |

| 复杂度 | 低 | 高 |

| 性能 | 高;无需解析内容 | 中;需要算法识别 URL,Cookie 和 HTTP head 等信息 |

| 安全性 | 低 | 高 |

| 额外功能 | 无 | 会话保持,图片压缩,等 |

总结:从上面的对比看来四层负载与七层负载最大的区别就是效率与功能的区别。四层负载架构设计比较简单,无需解析具体的消息内容,在网络吞吐量及处理能力上会相对比较高,而七层负载均衡的优势则体现在功能多,控制灵活强大。在具体业务架构设计时,使用七层负载或者四层负载还得根据具体的情况综合考虑。

(1)LVS 是 Linux Virtual Server的简称,也就是 Linux 虚拟服务器, 是一个由章文嵩博士发起的自由软件项目,它的官方站点是www.linuxvirtualserver.org。现在LVS已经是 Linux标准内核的一部分,因此性能较高。

(2)LVS软件作用:通过LVS提供的负载均衡技术和Linux操作系统实现一个高性能、高可用的服务器群集,它具有良好可靠性、可扩展性和可操作性。从而以低廉的成本实现最优的服务性能。

高并发连接:LVS基于内核网络层面工作,有超强的承载能力和并发处理能力。单台LVS负载均衡器,可支持上万并发连接。

稳定性强:是工作在网络4层之上仅作分发之用,这个特点也决定了它在负载均衡软件里的性能最强,稳定性最好,对内存和cpu资源消耗极低。

成本低廉:硬件负载均衡器少则十几万,多则几十万上百万,LVS只需一台服务器和就能免费部署使用,性价比极高。

配置简单:LVS配置非常简单,仅需几行命令即可完成配置,也可写成脚本进行管理。

支持多种算法:支持多种论调算法,可根据业务场景灵活调配进行使用

支持多种工作模型:可根据业务场景,使用不同的工作模式来解决生产环境请求处理问题。

应用范围广:因为LVS工作在4层,所以它几乎可以对所有应用做负载均衡,包括http、数据库、DNS、ftp服务等等

工作在4层,不支持7层规则修改,机制过于庞大,不适合小规模应用。

LVS的管理工具和内核模块 ipvsadm/ipvs

ipvsadm:用户空间的命令行工具,用于管理集群服务及集群服务上的RS等;

ipvs:工作于内核上的程序,可根据用户定义的集群实现请求转发;

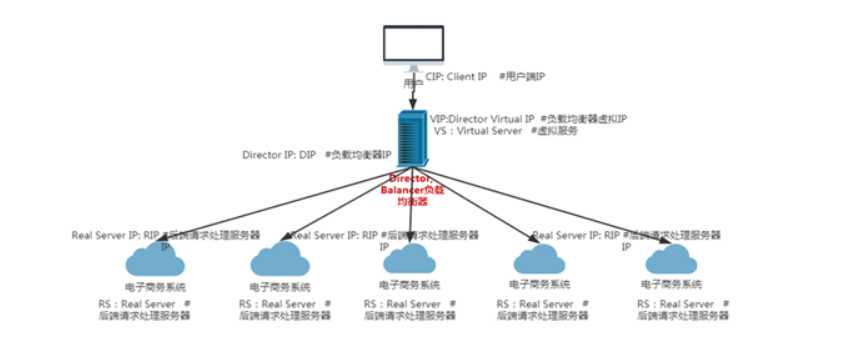

VS:Virtual Server #虚拟服务

Director, Balancer #负载均衡器、分发器

RS:Real Server #后端请求处理服务器

CIP: Client IP #用户端IP

VIP:Director Virtual IP #负载均衡器虚拟IP

DIP:Director IP #负载均衡器IP

RIP:Real Server IP #后端请求处理服务器IP

4、LVS负载均衡四种工作模式

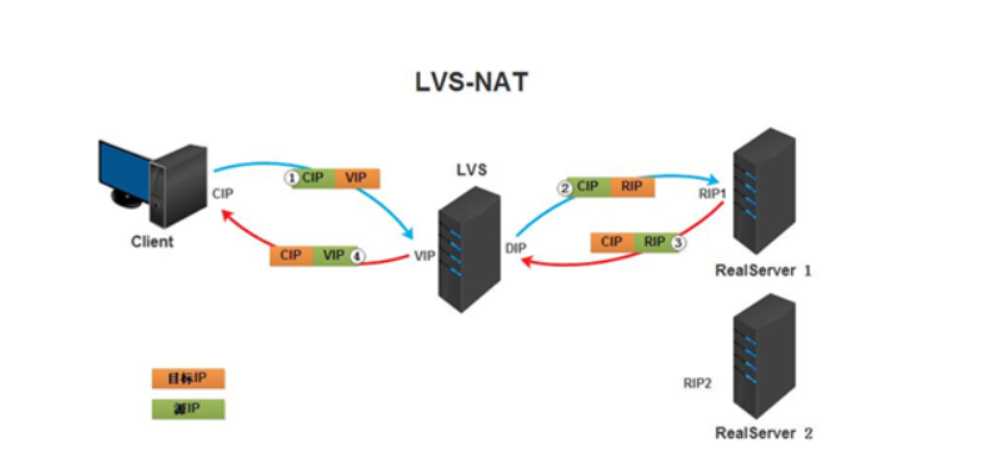

LVS/NAT:网络地址转换模式,进站/出站的数据流量经过分发器(IP负载均衡,他修改的是IP地址) --利用三层功能

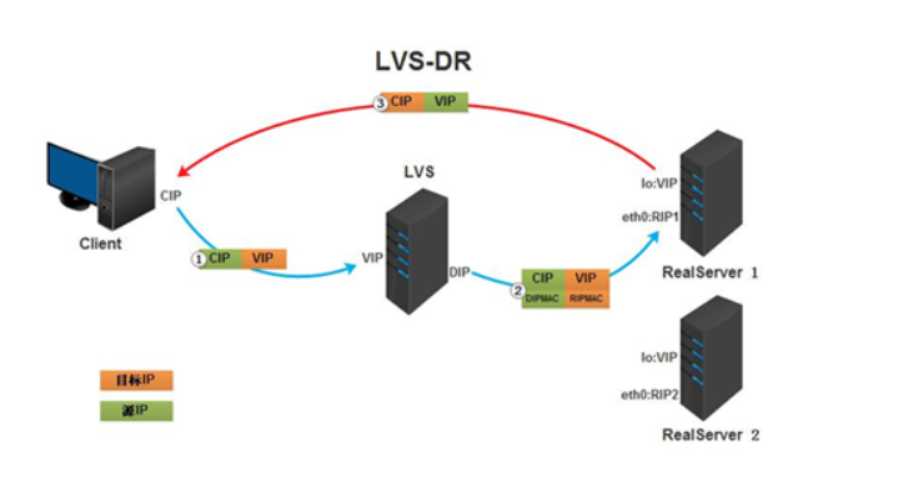

LVS/DR :直接路由模式,只有进站的数据流量经过分发器(数据链路层负载均衡,因为他修改的是目的mac地址)--利用二层功能mac地址

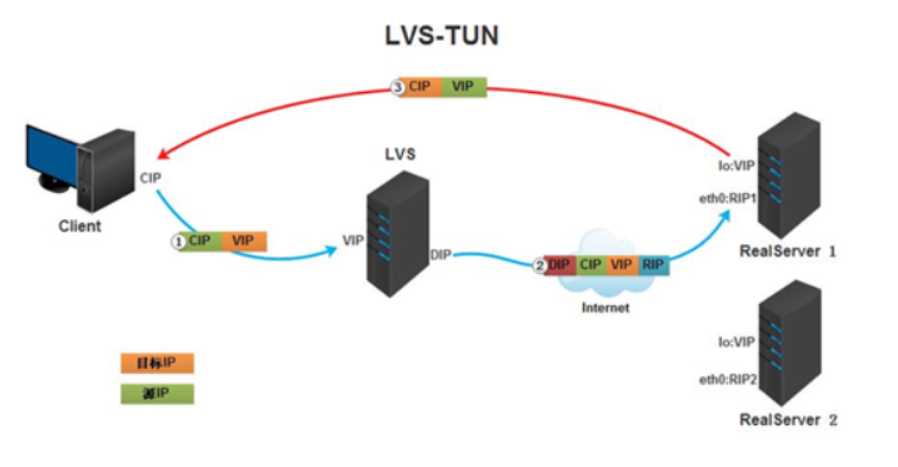

LVS/TUN: 隧道模式,只有进站的数据流量经过分发器

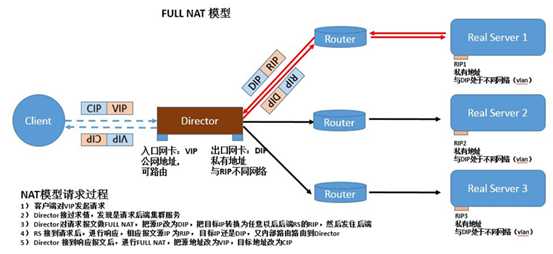

LVS/full-nat:双向转换:通过请求报文的源地址为DIP,目标为RIP来实现转发:对于响应报文而言,修改源地址为VIP,目标地址为CIP来实现转发

1、NAT模式(VS-NAT)

原理:就是把客户端发来的数据包的IP头的目的地址,在负载均衡器上换成其中一台RS的IP地址,并发至此RS来处理,RS处理完成后把数据交给经过负载均衡器,负载均衡器再把数据包的原IP地址改为自己的IP,将目的地址改为客户端IP地址即可?期间,无论是进来的流量,还是出去的流量,都必须经过负载均衡器?

优点:集群中的物理服务器可以使用任何支持TCP/IP操作系统,只有负载均衡器需要一个合法的IP地址。

缺点:扩展性有限。当服务器节点(普通PC服务器)增长过多时,负载均衡器将成为整个系统的瓶颈,因为所有的请求包和应答包的流向都经过负载均衡器。当服务器节点过多时,大量的数据包都交汇在负载均衡器那,速度就会变慢!

2、直接路由(Direct routing)模式(LVS-DR)

原理:负载均衡器和RS都使用同一个IP对外服务?但只有DR对ARP请求进行响应,所有RS对本身这个IP的ARP请求保持静默?也就是说,网关会把对这个服务IP的请求全部定向给DR,而DR收到数据包后根据调度算法,找出对应的RS,把目的MAC地址改为RS的MAC(因为IP一致)并将请求分发给这台RS?这时RS收到这个数据包,处理完成之后,由于IP一致,可以直接将数据返给客户,则等于直接从客户端收到这个数据包无异,处理后直接返回给客户端?

优点:和TUN(隧道模式)一样,负载均衡器也只是分发请求,应答包通过单独的路由方法返回给客户端。与VS-TUN相比,VS-DR这种实现方式不需要隧道结构,因此可以使用大多数操作系统做为物理服务器。

缺点:(不能说缺点,只能说是不足)要求负载均衡器的网卡必须与物理网卡在一个物理段上。

3、IP隧道(Tunnel)模式(VS-TUN)

? 原理:互联网上的大多Internet服务的请求包很短小,而应答包通常很大。那么隧道模式就是,把客户端发来的数据包,封装一个新的IP头标记(仅目的IP)发给RS,RS收到后,先把数据包的头解开,还原数据包,处理后,直接返回给客户端,不需要再经过负载均衡器?注意,由于RS需要对负载均衡器发过来的数据包进行还原,所以说必须支持IPTUNNEL协议?所以,在RS的内核中,必须编译支持IPTUNNEL这个选项

? 优点:负载均衡器只负责将请求包分发给后端节点服务器,而RS将应答包直接发给用户。所以,减少了负载均衡器的大量数据流动,负载均衡器不再是系统的瓶颈,就能处理很巨大的请求量,这种方式,一台负载均衡器能够为很多RS进行分发。而且跑在公网上就能进行不同地域的分发。

? 缺点:隧道模式的RS节点需要合法IP,这种方式需要所有的服务器支持”IP Tunneling”(IP Encapsulation)协议,服务器可能只局限在部分Linux系统上。

4、FULL-NAT模式原理:客户端对VIP发起请求,Director接过请求发现是请求后端服务。Direcrot对请求报文做full-nat,把源ip改为Dip,把目标ip转换为任意后端RS的rip,然后发往后端,rs接到请求后,进行响应,相应源ip为Rip目标ip还是DIP,又内部路由路由到Director,Director接到响应报文,进行full-nat。将源地址为VIP,目标地址改为CIP

请求使用DNAT,响应使用SNAT

lvs-nat与lvs-fullnat:请求和响应报文都经由Director

lvs-nat:RIP的网关要指向DIP

lvs-fullnat:RIP和DIP未必在同一IP网络,但要能通信

lvs-dr与lvs-tun:请求报文要经由Director,但响应报文由RS直接发往Client

lvs-dr:通过封装新的MAC首部实现,通过MAC网络转发

lvs-tun:通过在原IP报文外封装新IP头实现转发,支持远距离通信

yum -y install ipvsadm

程序包:ipvsadm(LVS管理工具)

主程序:/usr/sbin/ipvsadm

规则保存工具:/usr/sbin/ipvsadm-save > /path/to/file

配置文件:/etc/sysconfig/ipvsadm-config

-A --add-service #在服务器列表中新添加一条新的虚拟服务器记录

-s --scheduler #使用的调度算法, rr | wrr | lc | wlc | lblb | lblcr | dh | sh | sed | nq 默认调度算法是 wlc

例:ipvsadm -A -t 192.168.1.2:80 -s wrr

-a --add-server #在服务器表中添加一条新的真实主机记录

-t --tcp-service #说明虚拟服务器提供tcp服务

-u --udp-service #说明虚拟服务器提供udp服务

-r --real-server #真实服务器地址

-m --masquerading #指定LVS工作模式为NAT模式

-w --weight #真实服务器的权值

-g --gatewaying #指定LVS工作模式为直接路由器模式(也是LVS默认的模式)

-i --ip #指定LVS的工作模式为隧道模式

-p #会话保持时间,定义流量被转到同一个realserver的会话存留时间

例:ipvsadm -a -t 192.168.1.2:80 -r 192.168.2.10:80 -m -w 1

-E -edit-service #编辑内核虚拟服务器表中的一条虚拟服务器记录。

-D -delete-service #删除内核虚拟服务器表中的一条虚拟服务器记录。

-C -clear #清除内核虚拟服务器表中的所有记录。

-R -restore #恢复虚拟服务器规则

-S -save #保存虚拟服务器规则到标准输出,输出为-R 选项可读的格式

-e -edit-server #编辑一条虚拟服务器记录中的某条真实服务器记录

-d -delete-server #删除一条虚拟服务器记录中的某条真实服务器记录

-L|-l –list #显示内核虚拟服务器表

--numeric, -n:#以数字形式输出地址和端口号

--exact: #扩展信息,精确值

--connection,-c: #当前IPVS连接输出

--stats: #统计信息

--rate : #输出速率信息

参数也可以从/proc/net/ip_vs*映射文件中查看

-Z –zero #虚拟服务表计数器清零(清空当前的连接数量等)

由于HTTP是一种无状态协议,每次请求完毕之后就立即断开了,当用户浏览购物网站挑选商品的时候,看到一件商品加入购物车,此过程被重定向到了REALSERVER1上面来,当把第二件商品加入购物车又被重定向到了REALSERVER2上面,最后结账的时候在REALSERVER2上面,只有一件商品,这显然是用户无法接受的,此时就需要一种持久连接机制,来把同一用户的HTTP请求在超时时间内都重定向到同一台REALSERVER,超时时间可以自己定义,比如说2个小时,在超时时间内服务器会不断追踪用户的访问请求,把某一用户的所有请求都转发到同一台REALSERVER上面

对于电子商务网站来说,用户在挑选商品的时候使用的是80端口来浏览的,当付款的时候则是通过443的ssl加密的方式,当然当用户挑选完商品付款的时候我们当然不希望https的443跳转到另外一台REALSERVER,很显然应该是同一REALSERVER才对,这时候就要用到基于防火墙标记的持久连接,通过定义端口的姻亲关系来实现

无论ipvs使用何种scheduler,其都能够实现在指定时间范围内始终将来自同一个ip地址的请求发往同一个RS;此功能是通过lvs持久连接模板实现,其与调度方法无关;

iptables -t mangle -A PREROUTING -d 172.16.100.100 -p tcp --dport 80 -j MARK --set-mark 99

#在iptables 打上标记,把80端口标记为99

iptables -t mangle -A PREROUTING -d 172.16.100.100-p tcp --dport 443 -j MARK --set-mark 99

#在iptables打上标记,把443端口标记为99

ipvsadm -A -f 99 -s rr -p

在lvs上建立基于99号标记的虚拟服务

ipvsadm -a -f 99 -r 172.16.100.2 -g

设置后端服务地址

ipvsadm -a -f 99 -r 172.16.100.3 -g

随着业务的发展,网站的访问量越来越大,网站访问量已经从原来的1000QPS,变为3000QPS,网站已经不堪重负,响应缓慢,面对此场景,单纯靠单台LNMP的架构已经无法承载更多的用户访问,此时需要用负载均衡技术,对网站容量进行扩充,来解决承载的问题。

考虑解决方案?

横向:scale out 对磁盘等资源扩容

纵向:scale up 增加新的服务器

准备 3 台纯净的虚拟机,两台 web 服务器

[root@lvs-server ~]# yum -y install ipvsadm

程序包:ipvsadm(LVS管理工具)

主程序:/usr/sbin/ipvsadm

规则保存工具:/usr/sbin/ipvsadm-save > /path/to/file

配置文件:/etc/sysconfig/ipvsadm-config

实验说明:

1、LVS/NAT网络拓朴

| 主机名 | ip | 系统 | 用途 |

|---|---|---|---|

| client | 192.168.0.105 桥接 | mac | 客户端 |

| lvs-server | 192.168.0.108 桥接 192.168.72.130 仅主机 |

centos7.5 | 分发器 |

| real-server1 | 192.168.72.128 仅主机 | centos7.5 | web1 |

| real-server2 | 192.168.72.129 仅主机 | centos7.5 | web2 |

# 配置real-server (两服务器相同)

[root@real-server1 ~]# yum install httpd -y

[root@real-server1 ~]# echo lvs-web1 > /var/www/html/index.html

[root@real-server1 ~]# systemctl start httpd

[root@real-server1 ~]# ip route add default via 192.168.72.130 # 配置默认路由

# 配置lvs-server 开启路由转发

[root@lvs-server ~]# vim /etc/sysctl.conf

net.ipv4.ip_forward = 1

[root@lvs-server ~]# sysctl -p //确保打开路由转发

[root@lvs-server ~]# yum install ipvsadm -y

设置集群调度算法,(便于验证,此处使用轮询算法):

[root@lvs-server ~]# ipvsadm -A -t 192.168.0.108:80 -s rr

设置后端服务器:

[root@lvs-server ~]# ipvsadm -a -t 192.168.0.108:80 -r 192.168.72.128:80 -m

[root@lvs-server ~]# ipvsadm -a -t 192.168.0.108:80 -r 192.168.72.129:80 -m

查看ipvsadm规则:

[root@lvs-server ~]# ipvsadm -Ln

IP Virtual Server version 1.2.1 (size=4096)

Prot LocalAddress:Port Scheduler Flags

-> RemoteAddress:Port Forward Weight ActiveConn InActConn

TCP 192.168.0.108:80 rr

-> 192.168.72.128:80 Masq 1 0 7

-> 192.168.72.129:80 Masq 1 0 7

这些规则没有保存在配置文件,重启失效

# 做开启启动

[root@lvs-server ~]# systemctl enable ipvsadm

Created symlink from /etc/systemd/system/multi-user.target.wants/ipvsadm.service to /usr/lib/systemd/system/ipvsadm.service.

[root@lvs-server ~]# ipvsadm -Ln > /etc/sysconfig/ipvsadm

# 测试

[root@client ~]# elinks -dump http://192.168.0.108/

[root@client ~]# ab -c 1000 -n 1000 http://192.168.0.108/

实验说明:

1.网络使用NAT模式

2.DR模式要求Director DIP 和 所有RealServer RIP必须在同一个网段及广播域

3.所有节点网关均指定真实网关

| 主机名 | ip | 系统 | 用途 |

|---|---|---|---|

| client | 172.16.147.1 | mac | 客户端 |

| lvs-server | 172.16.147.154 | centos7.5 | 分发器 |

| real-server1 | 172.16.147.155 | centos7.5 | web1 |

| real-server2 | 172.16.147.156 | centos7.5 | web2 |

| vip for dr | 172.16/147.200 | (真实场景是公网ip) |

1、准备工作(集群中所有主机)关闭防火墙和selinux

[root@lvs-server ~]# cat /etc/hosts

127.0.0.1 localhost localhost.localdomain localhost4 localhost4.localdomain4

::1 localhost localhost.localdomain localhost6 localhost6.localdomain6

172.16.147.154 lvs-server

172.16.147.155 real-server1

172.16.147.156 real-server2

2、Director分发器配置

配置VIP

[root@lvs-server ~]# ip addr add dev ens33 172.16.147.200/32 #设置VIP

[root@lvs-server ~]# yum install -y ipvsadm #RHEL确保LoadBalancer仓库可用

[root@lvs-server ~]# service ipvsadm start #启动

注意:启动如果报错: /bin/bash: /etc/sysconfig/ipvsadm: 没有那个文件或目录

需要手动生成文件

[root@lvs-server ~]# ipvsadm --save > /etc/sysconfig/ipvsadm

定义LVS分发策略

-A:添加VIP

-t:用的是tcp协议

-a:添加的是lo的vip地址

-r:转发到realserverip

-s:算法

-L|-l –list #显示内核虚拟服务器表

--numeric, -n:#以数字形式输出地址和端口号

-g --gatewaying #指定LVS工作模式为直接路由器模式(也是LVS默认的模式)

-S -save #保存虚拟服务器规则到标准输出,输出为-R 选项可读的格式

rr:轮循

如果添加ip错了,删除命令如下:

# ip addr del 172.16.147.200 dev ens33

[root@lvs-server ~]# ipvsadm -C #清除内核虚拟服务器表中的所有记录。

[root@lvs-server ~]# ipvsadm -A -t 172.16.147.200:80 -s rr

[root@lvs-server ~]# ipvsadm -a -t 172.16.147.200:80 -r 172.16.147.155 -g

[root@lvs-server ~]# ipvsadm -a -t 172.16.147.200:80 -r 172.16.147.156 -g

[root@lvs-server ~]# service ipvsadm save #保存方式一,使用下面的保存方式,版本7已经不支持了

[root@lvs-server ~]# ipvsadm -S > /etc/sysconfig/ipvsadm #保存方式二,保存到一个文件中

[root@lvs-server ~]# ipvsadm -ln

IP Virtual Server version 1.2.1 (size=4096)

Prot LocalAddress:Port Scheduler Flags

-> RemoteAddress:Port Forward Weight ActiveConn InActConn

TCP 172.16.147.100:80 rr

-> 172.16.147.155:80 Route 1 0 0

-> 172.16.147.156:80 Route 1 0 0

[root@lvs-server ~]# ipvsadm -L -n

[root@lvs-server ~]# ipvsadm -L -n --stats #显示统计信息

1. Conns (connections scheduled) 已经转发过的连接数

2. InPkts (incoming packets) 入包个数

3. OutPkts (outgoing packets) 出包个数

4. InBytes (incoming bytes) 入流量(字节)

5. OutBytes (outgoing bytes) 出流量(字节)

[root@lvs-server ~]# ipvsadm -L -n --rate #看速率

1. CPS (current connection rate) 每秒连接数

2. InPPS (current in packet rate) 每秒的入包个数

3. OutPPS (current out packet rate) 每秒的出包个数

4. InBPS (current in byte rate) 每秒入流量(字节)

5. OutBPS (current out byte rate) 每秒出流量(字节)

3、所有RS配置

配置好网站服务器,测试所有RS #为了测试效果,提供不同的页面(以下两台real-server都操作)

[root@real-server1 ~]# yum install -y nginx

[root@real-server1 ~]# echo "real-server1" >> /usr/share/nginx/html/index.html

两台机器都安装,按顺序添加不同的主机名以示区分

[root@real-server1 ~]# ip addr add dev lo 172.16.147.200/32 #在lo接口上绑定VIP

[root@real-server1 ~]# echo 1 > /proc/sys/net/ipv4/conf/all/arp_ignore #忽略arp广播

[root@real-server1 ~]# echo 2 > /proc/sys/net/ipv4/conf/all/arp_announce #匹配精确ip地址回包

[root@real-server1 ~]# systemctl start nginx

[root@real-server1 ~]# systemctl enable nginx

=============================================================================

因为:realServer的vip有了,接着就是同一个网段中拥有两个vip, 客户端在网关发送arp广播需找vip时需要让realServer不接受响应.

解决:

echo 1 >/proc/sys/net/ipv4/conf/eth0/arp_ignore

arp_ignore?设置为1,意味着当别人的arp请求过来的时候,如果接收的设备没有这个ip,就不做出响应(这个ip在lo上,lo不是接收设备的进口)

echo 2 >/proc/sys/net/ipv4/conf/eth0/arp_announce?

使用最好的ip来回应,什么是最好的ip?同一个网段内子网掩码最长的

[root@client ~]# elinks -dump http://172.16.147.200

LVS的调度算法分为静态与动态两类。

只根据算法进行调度 而不考虑后端服务器的实际连接情况和负载情况

①.RR:轮叫调度(Round Robin)

调度器通过”轮叫”调度算法将外部请求按顺序轮流分配到集群中的真实服务器上,它均等地对待每一台服务器,而不管服务器上实际的连接数和系统负载?

②.WRR:加权轮叫(Weight RR)

调度器通过“加权轮叫”调度算法根据真实服务器的不同处理能力来调度访问请求。这样可以保证处理能力强的服务器处理更多的访问流量。调度器可以自动问询真实服务器的负载情况,并动态地调整其权值。

③.DH:目标地址散列调度(Destination Hash )

根据请求的目标IP地址,作为散列键(HashKey)从静态分配的散列表找出对应的服务器,若该服务器是可用的且未超载,将请求发送到该服务器,否则返回空。

④.SH:源地址 hash(Source Hash)

源地址散列”调度算法根据请求的源IP地址,作为散列键(HashKey)从静态分配的散列表找出对应的服务器,若该服务器是可用的且未超载,将请求发送到该服务器,否则返回空?

前端的调度器会根据后端真实服务器的实际连接情况来分配请求

①.LC:最少链接(Least Connections)

调度器通过”最少连接”调度算法动态地将网络请求调度到已建立的链接数最少的服务器上。如果集群系统的真实服务器具有相近的系统性能,采用”最小连接”调度算法可以较好地均衡负载。

②.WLC:加权最少连接(默认采用的就是这种)(Weighted Least Connections)

在集群系统中的服务器性能差异较大的情况下,调度器采用“加权最少链接”调度算法优化负载均衡性能,具有较高权值的服务器将承受较大比例的活动连接负载?调度器可以自动问询真实服务器的负载情况,并动态地调整其权值。

③.SED:最短期望延迟调度(Shortest Expected Delay )

在WLC基础上改进,Overhead = (ACTIVE+1)*256/加权,不再考虑非活动状态,把当前处于活动状态的数目+1来实现,数目最小的,接受下次请求,+1的目的是为了考虑加权的时候,非活动连接过多缺陷:当权限过大的时候,会倒置空闲服务器一直处于无连接状态。

④.NQ:永不排队/最少队列调度(Never Queue Scheduling NQ)

无需队列。如果有台 realserver的连接数=0就直接分配过去,不需要再进行sed运算,保证不会有一个主机很空闲。

⑤.LBLC:基于局部性的最少链接(locality-Based Least Connections)

基于局部性的最少链接”调度算法是针对目标IP地址的负载均衡,目前主要用于Cache集群系统?该算法根据请求的目标IP地址找出该目标IP地址最近使用的服务器,若该服务器是可用的且没有超载,将请求发送到该服务器;若服务器不存在,或者该服务器超载且有服务器处于一半的工作负载,则用“最少链接”的原则选出一个可用的服务器,将请求发送到该服务器?

⑥. LBLCR:带复制的基于局部性最少连接(Locality-Based Least Connections with Replication)

带复制的基于局部性最少链接”调度算法也是针对目标IP地址的负载均衡,目前主要用于Cache集群系统?它与LBLC算法的不同之处是它要维护从一个目标IP地址到一组服务器的映射,而LBLC算法维护从一个目标IP地址到一台服务器的映射?该算法根据请求的目标IP地址找出该目标IP地址对应的服务器组,按”最小连接”原则从服务器组中选出一台服务器,若服务器没有超载,将请求发送到该服务器;若服务器超载,则按“最小连接”原则从这个集群中选出一台服务器,将该服务器加入到服务器组中,将请求发送到该服务器?同时,当该服务器组有一段时间没有被修改,将最忙的服务器从服务器组中删除,以降低复制的程度。

keepalived是什么

keepalived是集群管理中保证集群高可用的一个服务软件,用来防止单点故障。

keepalived工作原理

keepalived是以VRRP协议为实现基础的,VRRP全称Virtual Router Redundancy Protocol,即虚拟路由冗余协议。

虚拟路由冗余协议,可以认为是实现路由器高可用的协议,即将N台提供相同功能的路由器组成一个路由器组,这个组里面有一个master和多个backup,master上面有一个对外提供服务的vip(该路由器所在局域网内其他机器的默认路由为该vip),master会发组播,当backup收不到vrrp包时就认为master宕掉了,这时就需要根据VRRP的优先级来选举一个backup当master。这样的话就可以保证路由器的高可用了。

keepalived主要有三个模块,分别是core、check和vrrp。core模块为keepalived的核心,负责主进程的启动、维护以及全局配置文件的加载和解析。check负责健康检查,包括常见的各种检查方式。vrrp模块是来实现VRRP协议的。

==============================================

脑裂 split barin:

Keepalived的BACKUP主机在收到不MASTER主机报文后就会切换成为master,如果是它们之间的通信线路出现问题,无法接收到彼此的组播通知,但是两个节点实际都处于正常工作状态,这时两个节点均为master强行绑定虚拟IP,导致不可预料的后果,这就是脑裂。

解决方式:

1、添加更多的检测手段,比如冗余的心跳线(两块网卡做健康监测),ping对方等等。尽量减少"裂脑"发生机会。(指标不治本,只是提高了检测到的概率);

2、设置仲裁机制。两方都不可靠,那就依赖第三方。比如启用共享磁盘锁,ping网关等。(针对不同的手段还需具体分析);

3、爆头,将master停掉。然后检查机器之间的防火墙。网络之间的通信

Nginx通过Upstream模块实现负载均衡

主机清单:

| 主机名 | ip | 系统 | 用途 |

|---|---|---|---|

| Proxy-master | 172.16.147.155 | centos7.5 | 主负载 |

| Proxy-slave | 172.16.147.156 | centos7.5 | 主备 |

| Real-server1 | 172.16.147.153 | Centos7.5 | web1 |

| Real-server2 | 172.16.147.154 | centos7.5 | Web2 |

| Vip for proxy | 172.16.147.100 |

轮询(默认):可以通过weight指定轮询的权重,权重越大,被调度的次数越多

ip_hash:可以实现会话保持,将同一客户的IP调度到同一样后端服务器,可以解决session的问题,不能使用weight

fair:可以根据请求页面的大小和加载时间长短进行调度,使用第三方的upstream_fair模块

url_hash:按请求的url的hash进行调度,从而使每个url定向到同一服务器,使用第三方的url_hash模块

配置安装nginx 所有的机器,关闭防火墙和selinux

[root@proxy-master ~]# systemctl stop firewalld //关闭防火墙

[root@proxy-master ~]# sed -i ‘s/^SELINUX=.*/SELINUX=disabled/‘ /etc/sysconfig/selinux //关闭selinux,重启生效

[root@proxy-master ~]# setenforce 0 //关闭selinux,临时生效

安装nginx, 全部4台

[root@proxy-master ~]# cd /etc/yum.repos.d/

[root@proxy-master yum.repos.d]# vim nginx.repo

[nginx-stable]

name=nginx stable repo

baseurl=http://nginx.org/packages/centos/$releasever/$basearch/

gpgcheck=0

enabled=1

[root@proxy-master yum.repos.d]# yum install yum-utils -y

[root@proxy-master yum.repos.d]# yum install nginx -y

调度到不同组后端服务器

网站分区进行调度

一、实施过程

1、选择两台nginx服务器作为代理服务器。

2、给两台代理服务器安装keepalived制作高可用生成VIP

3、配置nginx的负载均衡

# 两台配置完全一样

[root@proxy-master ~]# vim /etc/nginx/nginx.conf

user nginx;

worker_processes auto;

error_log /var/log/nginx/error.log;

pid /run/nginx.pid;

include /usr/share/nginx/modules/*.conf;

events {

worker_connections 1024;

}

http {

log_format main ‘$remote_addr - $remote_user [$time_local] "$request" ‘

‘$status $body_bytes_sent "$http_referer" ‘

‘"$http_user_agent" "$http_x_forwarded_for"‘;

access_log /var/log/nginx/access.log main;

sendfile on;

tcp_nopush on;

tcp_nodelay on;

keepalive_timeout 65;

types_hash_max_size 2048;

include /etc/nginx/mime.types;

default_type application/octet-stream;

include /etc/nginx/conf.d/*.conf;

upstream backend {

server 172.16.147.154:80 weight=1 max_fails=3 fail_timeout=20s;

server 172.16.147.153:80 weight=1 max_fails=3 fail_timeout=20s;

}

server {

listen 80;

server_name localhost;

location / {

proxy_pass http://backend;

proxy_set_header Host $host:$proxy_port;

proxy_set_header X-Forwarded-For $remote_addr;

}

}

}

调度到不同组后端服务器

网站分区进行调度

=================================================================================

拓扑结构

[vip: 20.20.20.20]

[LB1 Nginx] [LB2 Nginx]

192.168.1.2 192.168.1.3

[index] [milis] [videos] [images] [news]

1.11 1.21 1.31 1.41 1.51

1.12 1.22 1.32 1.42 1.52

1.13 1.23 1.33 1.43 1.53

... ... ... ... ...

/web /web/milis /web/videos /web/images /web/news

index.html index.html index.html index.html index.html

一、实施过程

根据站点分区进行调度

http {

upstream index {

server 192.168.1.11:80 weight=1 max_fails=2 fail_timeout=2;

server 192.168.1.12:80 weight=2 max_fails=2 fail_timeout=2;

server 192.168.1.13:80 weight=2 max_fails=2 fail_timeout=2;

}

upstream milis {

server 192.168.1.21:80 weight=1 max_fails=2 fail_timeout=2;

server 192.168.1.22:80 weight=2 max_fails=2 fail_timeout=2;

server 192.168.1.23:80 weight=2 max_fails=2 fail_timeout=2;

}

upstream videos {

server 192.168.1.31:80 weight=1 max_fails=2 fail_timeout=2;

server 192.168.1.32:80 weight=2 max_fails=2 fail_timeout=2;

server 192.168.1.33:80 weight=2 max_fails=2 fail_timeout=2;

}

upstream images {

server 192.168.1.41:80 weight=1 max_fails=2 fail_timeout=2;

server 192.168.1.42:80 weight=2 max_fails=2 fail_timeout=2;

server 192.168.1.43:80 weight=2 max_fails=2 fail_timeout=2;

}

upstream news {

server 192.168.1.51:80 weight=1 max_fails=2 fail_timeout=2;

server 192.168.1.52:80 weight=2 max_fails=2 fail_timeout=2;

server 192.168.1.53:80 weight=2 max_fails=2 fail_timeout=2;

}

server {

location / {

proxy_pass http://index;

}

location /news {

proxy_pass http://news;

}

location /milis {

proxy_pass http://milis;

}

location ~* \.(wmv|mp4|rmvb)$ {

proxy_pass http://videos;

}

location ~* \.(png|gif|jpg)$ {

proxy_pass http://images;

}

}

二、Keepalived实现调度器HA

注:主/备调度器均能够实现正常调度

1. 主/备调度器安装软件

[root@proxy-master ~]# yum install -y keepalived

[root@proxy-slave ~]# yum install -y keepalived

[root@proxy-master ~]# cp /etc/keepalived/keepalived.conf /etc/keepalived/keepalived.conf.bak

[root@proxy-master ~]# vim /etc/keepalived/keepalived.conf

! Configuration File for keepalived

global_defs {

router_id directory1 #辅助改为directory2

}

vrrp_instance VI_1 {

state MASTER #定义主还是备

interface ens33 #VIP绑定接口

virtual_router_id 80 #整个集群的调度器一致

priority 100 #back改为50

advert_int 1

authentication {

auth_type PASS

auth_pass 1111

}

virtual_ipaddress {

172.16.147.100/24 # vip

}

}

[root@proxy-slave ~]# cp /etc/keepalived/keepalived.conf /etc/keepalived/keepalived.conf.bak

[root@proxy-slave ~]# vim /etc/keepalived/keepalived.conf

! Configuration File for keepalived

global_defs {

router_id directory2

}

vrrp_instance VI_1 {

state BACKUP #设置为backup

interface ens33

nopreempt #设置到back上面,不抢占资源

virtual_router_id 80

priority 50 #辅助改为50

advert_int 1

authentication {

auth_type PASS

auth_pass 1111

}

virtual_ipaddress {

172.16.147.100/24

}

}

3. 启动KeepAlived(主备均启动)

[root@proxy-master ~]# systemctl enable keepalived

[root@proxy-slave ~]# systemctl start keepalived

[root@proxy-master ~]# ip a

1: lo: <LOOPBACK,UP,LOWER_UP> mtu 65536 qdisc noqueue state UNKNOWN group default qlen 1000

link/loopback 00:00:00:00:00:00 brd 00:00:00:00:00:00

inet 127.0.0.1/8 scope host lo

valid_lft forever preferred_lft forever

inet 172.16.147.100/32 scope global lo

valid_lft forever preferred_lft forever

inet6 ::1/128 scope host

valid_lft forever preferred_lft forever

2: ens33: <BROADCAST,MULTICAST,UP,LOWER_UP> mtu 1500 qdisc pfifo_fast state UP group default qlen 1000

link/ether 00:0c:29:ec:8a:fe brd ff:ff:ff:ff:ff:ff

inet 172.16.147.155/24 brd 172.16.147.255 scope global noprefixroute dynamic ens33

valid_lft 1115sec preferred_lft 1115sec

inet 172.16.147.101/24 scope global secondary ens33

valid_lft forever preferred_lft forever

到此:

可以解决心跳故障keepalived

不能解决Nginx服务故障

4. 扩展对调度器Nginx健康检查(可选)两台都设置

思路:

让Keepalived以一定时间间隔执行一个外部脚本,脚本的功能是当Nginx失败,则关闭本机的Keepalived

(1) script

[root@proxy-master ~]# vim /etc/keepalived/check_nginx_status.sh

#!/bin/bash

/usr/bin/curl -I http://localhost &>/dev/null

if [ $? -ne 0 ];then

# /etc/init.d/keepalived stop

systemctl stop keepalived

fi

[root@proxy-master ~]# chmod a+x /etc/keepalived/check_nginx_status.sh

(2). keepalived使用script

! Configuration File for keepalived

global_defs {

router_id director1

}

vrrp_script check_nginx {

script "/etc/keepalived/check_nginx_status.sh"

interval 5

}

vrrp_instance VI_1 {

state MASTER

interface ens33

virtual_router_id 80

priority 100

advert_int 1

authentication {

auth_type PASS

auth_pass 1111

}

virtual_ipaddress {

192.168.246.16/24

}

track_script {

check_nginx

}

}

注:必须先启动nginx,再启动keepalived

| 主机名 | ip | 系统 | 用途 |

|---|---|---|---|

| client | 172.16.147.1 | mac | 客户端 |

| lvs-keepalived-master | 172.16.147.154 | centos7.5 | 分发器 |

| lvs-keepalived-slave | 172.16.147.155 | centos7.5 | 分发器备 |

| test-nginx1 | 172.16.147.153 | centos7.5 | web1 |

| test-nginx2 | 172.16.147.156 | centos7.5 | web2 |

| vip | 172.16/147.101 |

LVS_Director + KeepAlived

KeepAlived在该项目中的功能:

1. 管理IPVS的路由表(包括对RealServer做健康检查)

2. 实现调度器的HA

http://www.keepalived.org

Keepalived所执行的外部脚本命令建议使用绝对路径

实施步骤:

1. 主/备调度器安装软件

[root@lvs-keepalived-master ~]# yum -y install ipvsadm keepalived

[root@lvs-keepalived-slave ~]# yum -y install ipvsadm keepalived

2. Keepalived

lvs-master

[root@lvs-keepalived-master ~]# vim /etc/keepalived/keepalived.conf

! Configuration File for keepalived

global_defs {

router_id lvs-keepalived-master #辅助改为lvs-backup

}

vrrp_instance VI_1 {

state MASTER

interface ens33 #VIP绑定接口

virtual_router_id 80 #VRID 同一组集群,主备一致

priority 100 #本节点优先级,辅助改为50

advert_int 1 #检查间隔,默认为1s

authentication {

auth_type PASS

auth_pass 1111

}

virtual_ipaddress {

172.16.147.101/24

}

}

virtual_server 172.16.147.101 80 { #LVS配置

delay_loop 3

lb_algo rr #LVS调度算法

lb_kind DR #LVS集群模式(路由模式)

nat_mask 255.255.255.0

protocol TCP #健康检查使用的协议

real_server 172.16.147.153 80 {

weight 1

inhibit_on_failure #当该节点失败时,把权重设置为0,而不是从IPVS中删除

TCP_CHECK { #健康检查

connect_port 80 #检查的端口

connect_timeout 3 #连接超时的时间

}

}

real_server 172.16.147.156 80 {

weight 1

inhibit_on_failure

TCP_CHECK {

connect_timeout 3

connect_port 80

}

}

}

[root@lvs-keepalived-slave ~]# vim /etc/keepalived/keepalived.conf

! Configuration File for keepalived

global_defs {

router_id lvs-keepalived-slave

}

vrrp_instance VI_1 {

state BACKUP

interface ens33

nopreempt #不抢占资源

virtual_router_id 80

priority 50

advert_int 1

authentication {

auth_type PASS

auth_pass 1111

}

virtual_ipaddress {

172.16.147.101/24

}

}

virtual_server 172.16.147.101 80 {

delay_loop 3

lb_algo rr

lb_kind DR

nat_mask 255.255.255.0

protocol TCP

real_server 172.16.147.153 80 {

weight 1

inhibit_on_failure

TCP_CHECK {

connect_port 80

connect_timeout 3

}

}

real_server 172.16.147.156 80 {

weight 1

inhibit_on_failure

TCP_CHECK {

connect_timeout 3

connect_port 80

}

}

}

3. 启动KeepAlived(主备均启动)

[root@lvs-keepalived-master ~]# systemctl start keepalived

[root@lvs-keepalived-master ~]# systemctl enable keepalived

[root@lvs-keepalived-master ~]# ipvsadm -Ln

IP Virtual Server version 1.2.1 (size=4096)

Prot LocalAddress:Port Scheduler Flags

-> RemoteAddress:Port Forward Weight ActiveConn InActConn

TCP 172.16.147.101:80 rr persistent 20

-> 172.16.147.153:80 Route 1 0 0

-> 172.16.147.156:80 Route 0 0 0

4. 所有RS配置(nginx1,nginx2)

配置好网站服务器,测试所有RS

[root@test-nginx1 ~]# yum install -y nginx

[root@test-nginx2 ~]# yum install -y nginx

[root@test-nginx1 ~]# echo "ip addr add dev lo 172.16.147.101/32" >> /etc/rc.local

[root@test-nginx1 ~]# echo "net.ipv4.conf.all.arp_ignore = 1" >> /etc/sysctl.conf

[root@test-nginx1 ~]# sysctl -p

[root@test-nginx1 ~]# echo "web1..." >> /usr/share/nginx/html/index.html

[root@test-nginx1 ~]# systemctl start nginx

[root@test-nginx1 ~]# chmod +x /etc/rc.local

LB集群测试

所有分发器和Real Server都正常

主分发器故障及恢复

Keepalived+mysql 自动切换

项目环境:

VIP 192.168.246.100

mysql1 192.168.246.162 keepalived-master

mysql2 192.168.246.163 keepalived-salve

一、mysql 主主同步 (不使用共享存储,数据保存本地存储)

二、安装keepalived

三、keepalived 主备配置文件

四、mysql状态检测脚本/root/bin/keepalived_check_mysql.sh

五、测试及诊断

实施步骤:

一、mysql 主主同步

二、安装keepalived---两台机器都操作

[root@mysql-keepalived-master ~]# yum -y install keepalived

[root@mysql-keepalived-slave ~]# yum -y install keepalived

三、keepalived 主备配置文件

192.168.246.162 master配置

[root@mysql-keepalived-master ~]# cp /etc/keepalived/keepalived.conf /etc/keepalived/keepalived.conf.bak

[root@mysql-keepalived-master ~]# vim /etc/keepalived/keepalived.conf

! Configuration File for keepalived

global_defs {

router_id master

}

vrrp_script check_run {

script "/etc/keepalived/keepalived_chech_mysql.sh"

interval 5

}

vrrp_instance VI_1 {

state MASTER

interface ens33

virtual_router_id 89

priority 100

advert_int 1

authentication {

auth_type PASS

auth_pass 1111

}

virtual_ipaddress {

192.168.246.100/24

}

track_script {

check_run

}

}

slave 192.168.246.163 配置

[root@mysql-keepalived-slave ~]# cp /etc/keepalived/keepalived.conf /etc/keepalived/keepalived.conf.bak

[root@mysql-keepalived-slave ~]# vim /etc/keepalived/keepalived.conf

! Configuration File for keepalived

global_defs {

router_id backup

}

vrrp_script check_run {

script "/etc/keepalived/keepalived_check_mysql.sh"

interval 5

}

vrrp_instance VI_1 {

state BACKUP

nopreempt

interface ens33

virtual_router_id 89

priority 50

advert_int 1

authentication {

auth_type PASS

auth_pass 1111

}

virtual_ipaddress {

192.168.246.100/24

}

track_script {

check_run

}

}

四、mysql状态检测脚本/root/keepalived_check_mysql.sh(两台MySQL同样的脚本)

版本一:简单使用:

[root@mysql-keepalived-master ~]# vim /etc/keepalived/keepalived_check_mysql.sh

#!/bin/bash

/usr/bin/mysql -uroot -p‘QianFeng@2019!‘ -e "show status" &>/dev/null

if [ $? -ne 0 ] ;then

# service keepalived stop

systemctl stop keepalived

fi

[root@mysql-keepalived-master ~]# chmod +x /etc/keepalived/keepalived_check_mysql.sh

==========================================================================

两边均启动keepalived

方式一:

[root@mysql-keepalived-master ~]# systemctl start keepalived

[root@mysql-keepalived-master ~]# systemctl enable keepalived

方式二:

# /etc/init.d/keepalived start

# /etc/init.d/keepalived start

# chkconfig --add keepalived

# chkconfig keepalived on

注意:在任意一台机器作为客户端。在测试的时候记得检查mysql用户的可不可以远程登录。

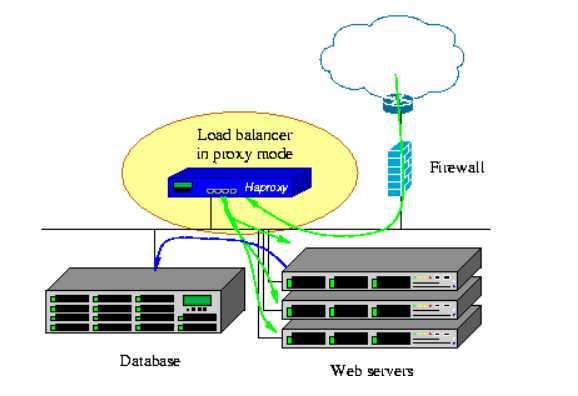

软件:haproxy---主要是做负载均衡的7层,也可以做4层负载均衡

apache也可以做7层负载均衡,但是很麻烦。实际工作中没有人用。

负载均衡是通过OSI协议对应的

7层负载均衡:用的7层http协议,

4层负载均衡:用的是tcp协议加端口号做的负载均衡

------------------------------------------------------------------------------------------------------------------------------

ha-proxy概述

ha-proxy是一款高性能的负载均衡软件。因为其专注于负载均衡这一些事情,因此与nginx比起来在负载均衡这件事情上做更好,更专业。

ha-proxy的特点

ha-proxy 作为目前流行的负载均衡软件,必须有其出色的一面。下面介绍一下ha-proxy相对LVS,Nginx等负载均衡软件的优点。

?支持tcp / http 两种协议层的负载均衡,使得其负载均衡功能非常丰富。

?支持8种左右的负载均衡算法,尤其是在http模式时,有许多非常实在的负载均衡算法,适用各种需求。

?性能非常优秀,基于事件驱动的链接处理模式及单进程处理模式(和Nginx类似)让其性能卓越。

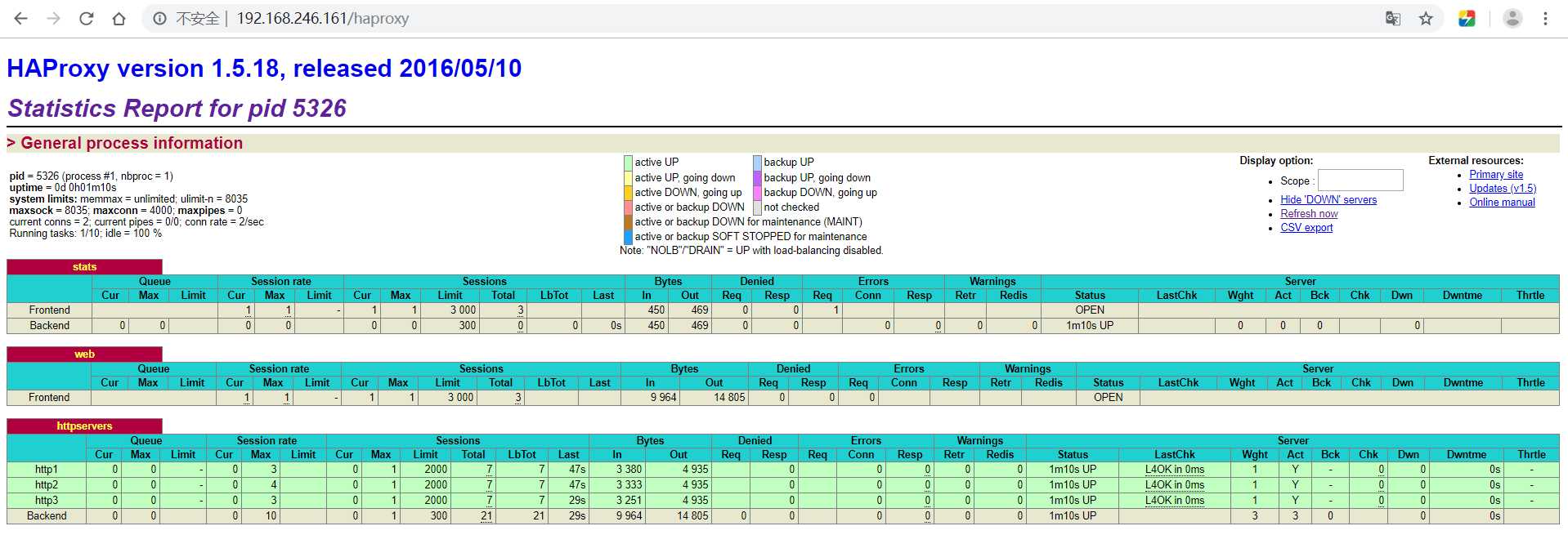

?拥有一个功能出色的监控页面,实时了解系统的当前状况。

?功能强大的ACL支持,给用户极大的方便。

haproxy算法:

1.roundrobin

基于权重进行轮询,在服务器的处理时间保持均匀分布时,这是最平衡,最公平的算法.此算法是动态的,这表示其权重可以在运行时进行调整.不过在设计上,每个后端服务器仅能最多接受4128个连接

2.static-rr

基于权重进行轮询,与roundrobin类似,但是为静态方法,在运行时调整其服务器权重不会生效.不过,其在后端服务器连接数上没有限制

3.leastconn

新的连接请求被派发至具有最少连接数目的后端服务器.

1、Haproxy 实现七层负载

Keepalived + Haproxy

/etc/haproxy/haproxy.cfg

global //关于进程的全局参数

log 127.0.0.1 local2 info #日志服务器

pidfile /var/run/haproxy.pid #pid文件

maxconn 4000 #最大连接数

user haproxy #用户

group haproxy #组

daemon #守护进程方式后台运行

nbproc 1 #工作进程数量 cpu内核是几就写几

defaults 段用于为其它配置段提供默认参数

listen 是frontend和backend的结合体

frontend 虚拟服务VIrtual Server

backend 真实服务器Real Server

调度器可以同时为多个站点调度,如果使用frontend、backend的方式:

frontend1 backend1

frontend2 backend2

frontend3 backend3

Keepalived + Haproxy

拓扑结构

[vip: 192.168.246.17]

[LB1 Haproxy] [LB2 Haproxy]

192.168.246.169 192.168.246.161

[httpd] [httpd]

192.168.246.162 192.168.246.163

一、Haproxy实施步骤

1. 准备工作(集群中所有主机)

[root@ha-proxy-master ~]# cat /etc/hosts

127.0.0.1 localhost

192.168.246.169 ha-proxy-master

192.168.246.161 ha-proxy-slave

192.168.246.162 test-nginx1

192.168.246.163 test-nginx2

2. RS配置

配置好网站服务器,测试所有RS,所有机器安装nginx

[root@test-nginx1 ~]# yum install -y nginx

[root@test-nginx1 ~]# systemctl start nginx

[root@test-nginx1 ~]# echo "test-nginx1" >> /usr/share/nginx/html/index.html

# 所有nginx服务器按顺序输入编号,方便区分。

3. 调度器配置Haproxy(主/备)都执行

[root@ha-proxy-master ~]# yum -y install haproxy

[root@ha-proxy-master ~]# cp -rf /etc/haproxy/haproxy.cfg{,.bak}

[root@ha-proxy-master ~]# sed -i -r ‘/^[ ]*#/d;/^$/d‘ /etc/haproxy/haproxy.cfg

[root@ha-proxy-master ~]# vim /etc/haproxy/haproxy.cfg

global

log 127.0.0.1 local2 info

pidfile /var/run/haproxy.pid

maxconn 4000 #优先级低

user haproxy

group haproxy

daemon #以后台形式运行ha-proxy

nbproc 1 #工作进程数量 cpu内核是几就写几

defaults

mode http #工作模式 http ,tcp 是 4 层,http是 7 层

log global

retries 3 #健康检查。3次连接失败就认为服务器不可用,主要通过后面的check检查

option redispatch #服务不可用后重定向到其他健康服务器。

maxconn 4000 #优先级中

contimeout 5000 #ha服务器与后端服务器连接超时时间,单位毫秒ms

clitimeout 50000 #客户端超时

srvtimeout 50000 #后端服务器超时

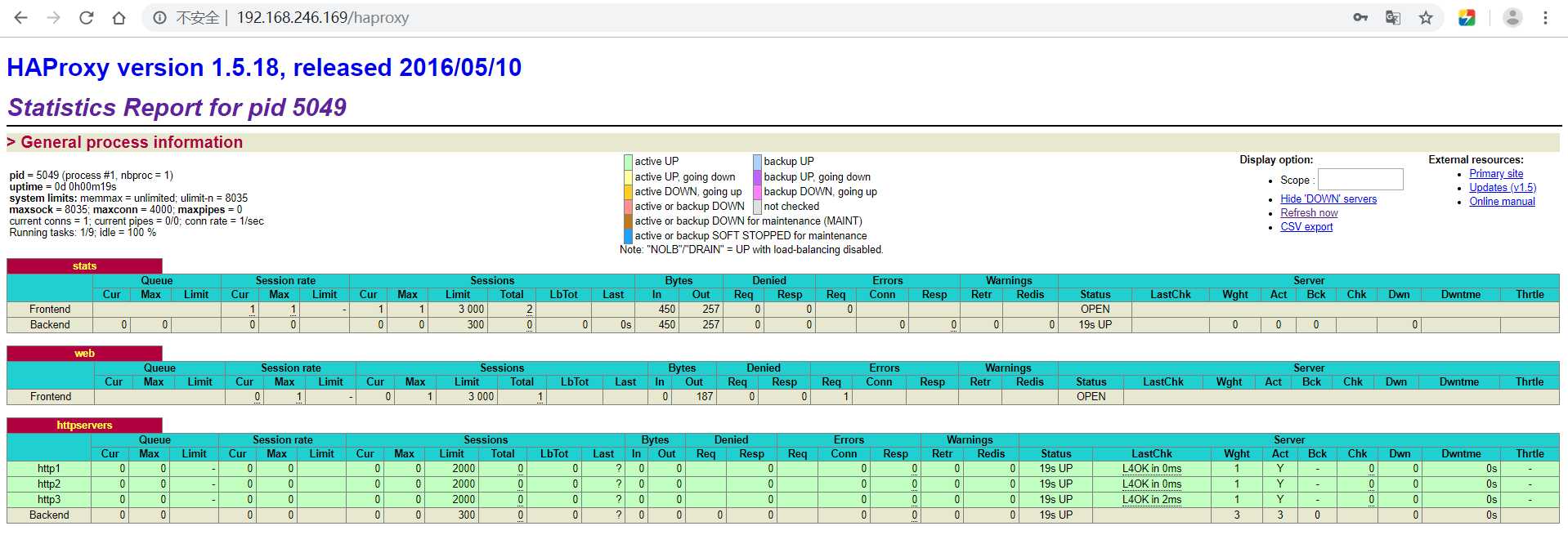

listen stats

bind *:80

stats enable

stats uri /haproxy #使用浏览器访问 http://192.168.246.169/haproxy,可以看到服务器状态

stats auth qianfeng:123 #用户认证,客户端使用elinks浏览器的时候不生效

frontend web

mode http

bind *:80 #监听哪个ip和什么端口

option httplog #日志类别 http 日志格式

acl html url_reg -i \.html$ #1.访问控制列表名称html。规则要求访问以html结尾的url

use_backend httpservers if html #2.如果满足acl html规则,则推送给后端服务器httpservers

default_backend httpservers #默认使用的服务器组

backend httpservers #名字要与上面的名字必须一样

balance roundrobin #负载均衡的方式

server http1 192.168.246.162:80 maxconn 2000 weight 1 check inter 1s rise 2 fall 2

server http2 192.168.246.163:80 maxconn 2000 weight 1 check inter 1s rise 2 fall 2

将配置文件拷贝到slave服务器

[root@ha-proxy-master ~]# scp /etc/haproxy/haproxy.cfg 192.168.246.161:/etc/haproxy/

两台机器启动设置开机启动

[root@ha-proxy-master ~]# systemctl start haproxy

[root@ha-proxy-master ~]# systemctl enable haproxy

#check inter 2000 检测心跳频率

#rise 2 2 次正确认为服务器可用

#fall 2 2 次失败认为服务器不可用

4.测试主/备(浏览器访问)

主:

备:

页面主要参数解释

Queue

Cur: current queued requests //当前的队列请求数量

Max:max queued requests ????//最大的队列请求数量

Limit: ??????????//队列限制数量

Errors

Req:request errors ????????????//错误请求

Conn:connection errors ?????????//错误的连接

Server列表:

Status:状态,包括up(后端机活动)和down(后端机挂掉)两种状态

LastChk: ???持续检查后端服务器的时间

Wght: (weight) : 权重

========================================================

2.测试访问

通过访问haparoxy的ip地址访问到后端服务器

# curl http://192.168.246.169

如果出现bind失败的报错,执行下列命令

setsebool -P haproxy_connect_any=1

二、Keepalived实现调度器HA

注:主/备调度器均能够实现正常调度

1. 主/备调度器安装软件

[root@ha-proxy-master ~]# yum install -y keepalived

[root@ha-proxy-slave ~]# yum install -y keepalived

[root@ha-proxy-master ~]# cp /etc/keepalived/keepalived.conf /etc/keepalived/keepalived.conf.bak

[root@ha-proxy-master ~]# vim /etc/keepalived/keepalived.conf

! Configuration File for keepalived

global_defs {

router_id director1

}

vrrp_instance VI_1 {

state MASTER

interface ens33

virtual_router_id 80

priority 100

advert_int 1

authentication {

auth_type PASS

auth_pass 1111

}

virtual_ipaddress {

192.168.246.17/24

}

}

[root@ha-proxy-slave ~]# cp /etc/keepalived/keepalived.conf /etc/keepalived/keepalived.conf.bak

[root@ha-proxy-slave ~]# vim /etc/keepalived/keepalived.conf

! Configuration File for keepalived

global_defs {

router_id directory2

}

vrrp_instance VI_1 {

state BACKUP

interface ens33

nopreempt

virtual_router_id 80

priority 50

advert_int 1

authentication {

auth_type PASS

auth_pass 1111

}

virtual_ipaddress {

192.168.246.17/24

}

}

3. 启动KeepAlived(主备均启动)

[root@ha-proxy-master ~]# chkconfig keepalived on

[root@ha-proxy-master ~]# service keepalived start

[root@ha-proxy-master ~]# ip a

4. 扩展对调度器Haproxy健康检查(可选)

思路:两台机器都做

让Keepalived以一定时间间隔执行一个外部脚本,脚本的功能是当Haproxy失败,则关闭本机的Keepalived

a. script

[root@ha-proxy-master ~]# cat /etc/keepalived/check_haproxy_status.sh

#!/bin/bash /usr/bin/curl -I http://localhost &>/dev/null

if [ $? -ne 0 ];then

# /etc/init.d/keepalived stop

systemctl stop keepalived

fi

[root@ha-proxy-master ~]# chmod a+x /etc/keepalived/check_haproxy_status.sh

b. keepalived使用script

[root@ha-proxy-master keepalived]# vim keepalived.conf

! Configuration File for keepalived

global_defs {

router_id director1

}

vrrp_script check_haproxy {

script "/etc/keepalived/check_haproxy_status.sh"

interval 5

}

vrrp_instance VI_1 {

state MASTER

interface ens33

virtual_router_id 80

priority 100

advert_int 1

authentication {

auth_type PASS

auth_pass 1111

}

virtual_ipaddress {

192.168.246.17/24

}

track_script {

check_haproxy

}

}

[root@ha-proxy-slave keepalived]# vim keepalived.conf

! Configuration File for keepalived

global_defs {

router_id directory2

}

vrrp_script check_haproxy {

script "/etc/keepalived/check_haproxy_status.sh"

interval 5

}

vrrp_instance VI_1 {

state BACKUP

interface ens33

nopreempt

virtual_router_id 80

priority 50

advert_int 1

authentication {

auth_type PASS

auth_pass 1111

}

virtual_ipaddress {

192.168.246.17/24

}

track_script {

check_haproxy

}

}

[root@ha-proxy-master keepalived]# systemctl restart keepalived

[root@ha-proxy-slave keepalived]# systemctl restart keepalived

注:必须先启动haproxy,再启动keepalived

两台机器都配置haproxy的日志:需要打开注释并添加

[root@ha-proxy-master ~]# vim /etc/rsyslog.conf

# Provides UDP syslog reception #由于haproxy的日志是用udp传输的,所以要启用rsyslog的udp监听

$ModLoad imudp

$UDPServerRun 514

找到 #### RULES #### 下面添加

local2.* /var/log/haproxy.log

[root@ha-proxy-master ~]# systemctl restart rsyslog

[root@ha-proxy-master ~]# systemctl restart haproxy

[root@ha-proxy-master ~]# tail -f /var/log/haproxy.log

2019-07-13T23:11:35+08:00 localhost haproxy[906]: Connect from 192.168.246.1:56866 to 192.168.246.17:80 (web/HTTP)

2019-07-13T23:11:35+08:00 localhost haproxy[906]: Connect from 192.168.246.1:56867 to 192.168.246.17:80 (web/HTTP)

2019-07-13T23:13:39+08:00 localhost haproxy[906]: Connect from 192.168.246.1:56889 to 192.168.246.17:80 (stats/HTTP)

2019-07-13T23:13:39+08:00 localhost haproxy[906]: Connect from 192.168.246.1:56890 to 192.168.246.17:80 (web/HTTP)

2019-07-13T23:14:07+08:00 localhost haproxy[906]: Connect from 192.168.246.1:56895 to 192.168.246.17:80 (web/HTTP)

2019-07-13T23:14:07+08:00 localhost haproxy[906]: Connect from 192.168.246.1:56896 to 192.168.246.17:80 (stats/HTTP)

两台haproxy配置文件:

[root@ha-proxy-master ~]# cat /etc/haproxy/haproxy.cfg

Haproxy L4

=================================================================================

global

log 127.0.0.1 local2

pidfile /var/run/haproxy.pid

maxconn 4000

user haproxy

group haproxy

daemon

nbproc 1

defaults

mode http

log global

option redispatch

retries 3

maxconn 4000

contimeout 5000

clitimeout 50000

srvtimeout 50000

listen stats

bind *:80

stats enable

stats uri /haproxy

stats auth qianfeng:123

frontend web

mode http

bind *:80

option httplog

default_backend httpservers

backend httpservers

balance roundrobin

server http1 192.168.246.162:80 maxconn 2000 weight 1 check inter 1s rise 2 fall 2

server http2 192.168.246.163:80 maxconn 2000 weight 1 check inter 1s rise 2 fall 2

listen mysql

bind *:3306

mode tcp

balance roundrobin

server mysql1 192.168.246.163:3306 weight 1 check inter 1s rise 2 fall 2

server mysql2 192.168.246.162:3306 weight 1 check inter 1s rise 2 fall 2

找一台机器做为客户端去测试,在测试的时候注意mysql的远程登录权限

标签:匹配 同步 自己 关闭selinux tin bash war 静态方法 路由器

原文地址:https://www.cnblogs.com/pengpengboshi/p/13278477.html