标签:rip 是你 端口冲突 centos7安装 修改 防火 tar 就是 selinux。

第一台正常安装,后两台做克隆。配置好IP地址,关闭防火墙跟SELINUX。

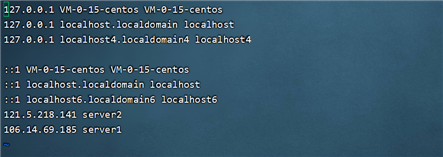

106.14.69.185 server1

121.5.218.141 server2

(2)修改用户名以及对应的IP

改为server1

另外两台虚拟机也按同样的设置,例如:centos7 2 为server2

设置完成后每台虚拟机都需要重启,重启生效。

配置完成后使用ping命令检查这3个机器是否相互ping得通,以server1为例,在什么执行命令:

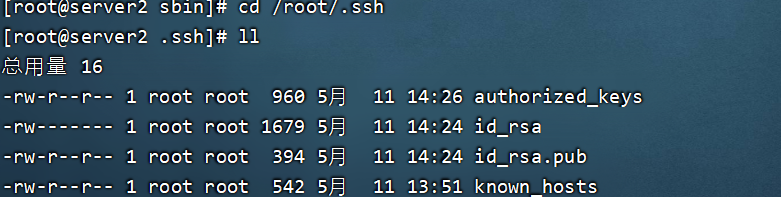

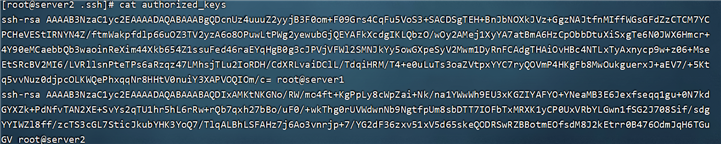

在命令执行过程中敲击两遍回车,然后在/root/.ssh文件下生成id_dsa id_dsa.pub

在该文件下建立一个authorized_keys文件,将id_dsa.pub文件内容拷贝到authorized_keys文件中

另外两个虚拟机也执行 #ssh-keygen -t dsa操作,并分别将id_dsa.pub内容拷贝到第一台虚拟机的authorized_keys文件中。将第一台的authorized_keys文件拷贝到另外两台虚拟机的/root/.ssh/ 下面

注意:以下搭建过程中的端口设置,请先检查个人服务器是否有端口冲突

1 解压hadoop

2新建几个目录

在/root目录下新建几个目录,复制粘贴执行下面的命令:

mkdir /root/hadoop mkdir /root/hadoop/tmp mkdir /root/hadoop/var mkdir /root/hadoop/dfs mkdir /root/hadoop/dfs/name mkdir /root/hadoop/dfs/data

/opt/hadoop/hadoop-3.2.0/etc/hadoop/

在<configuration>节点内加入配置:

<property>

<name>hadoop.tmp.dir</name>

<value>/root/hadoop/tmp</value>

<description>Abase for other temporary directories.</description>

</property>

<property>

<name>fs.default.name</name>

<value>hdfs://server1:9000</value>

</property>

注意: <value>hdfs://server1:9000</value> 此处应与hostname保持一致

将export JAVA_HOME=${JAVA_HOME}

修改为:

export JAVA_HOME=/var/liangxiaodong/soft/jdk1.8.0_202

<property> <name>dfs.name.dir</name> <value>/root/hadoop/dfs/name</value> <description>Path on the local filesystem where theNameNode stores the namespace and transactions logs persistently.</description> </property> <property> <name>dfs.data.dir</name> <value>/root/hadoop/dfs/data</value> <description>Comma separated list of paths on the localfilesystem of a DataNode where it should store its blocks.</description> </property> <property> <name>dfs.replication</name> <value>2</value> </property> <property> <name>dfs.permissions</name> <value>false</value> <description>need not permissions</description> </property>

说明:dfs.permissions配置为false后,可以允许不要检查权限就生成dfs上的文件,方便倒是方便了,但是你需要防止误删除,请将它设置为true,或者直接将该property节点删除,因为默认就是true

在该版本中,有一个名为mapred-site.xml的文件,复制该文件,后改名mapred-site.xml.template,命令是:

cp mapred-site.xml mapred-site.xml.template

修改这个新建的mapred-site.xml文件,在<configuration>节点内加入配置:

<property> <name>mapred.job.tracker</name> <value>server1:49001</value> </property> <property> <name>mapred.local.dir</name> <value>/root/hadoop/var</value> </property> <property> <name>mapreduce.framework.name</name> <value>yarn</value> </property>

注意: <value>server1:49001</value>

修改worker文件,将里面的localhost删除,添加如下内容:

server2

server3

第二台虚拟机添加如下内容:

<property>

<name>yarn.resourcemanager.hostname</name>

<value>server1</value>

</property>

<property>

<description>The address of the applications manager interface in the RM.</description>

<name>yarn.resourcemanager.address</name>

<value>${yarn.resourcemanager.hostname}:8032</value>

</property>

<property>

<description>The address of the scheduler interface.</description>

<name>yarn.resourcemanager.scheduler.address</name>

<value>${yarn.resourcemanager.hostname}:8030</value>

</property>

<property>

<description>The http address of the RM web application.</description>

<name>yarn.resourcemanager.webapp.address</name>

<value>${yarn.resourcemanager.hostname}:8088</value>

</property>

<property>

<description>The https adddress of the RM web application.</description>

<name>yarn.resourcemanager.webapp.https.address</name>

<value>${yarn.resourcemanager.hostname}:8090</value>

</property>

<property>

<name>yarn.resourcemanager.resource-tracker.address</name>

<value>${yarn.resourcemanager.hostname}:8031</value>

</property>

<property>

<description>The address of the RM admin interface.</description>

<name>yarn.resourcemanager.admin.address</name>

<value>${yarn.resourcemanager.hostname}:8033</value>

</property>

<property>

<name>yarn.nodemanager.aux-services</name>

<value>mapreduce_shuffle</value>

</property>

<property>

<name>yarn.scheduler.maximum-allocation-mb</name>

<value>2048</value>

<discription>每个节点可用内存,单位MB,默认8182MB</discription>

</property>

<property>

<name>yarn.nodemanager.vmem-pmem-ratio</name>

<value>2.1</value>

</property>

<property>

<name>yarn.nodemanager.resource.memory-mb</name>

<value>2048</value>

</property>

<property>

<name>yarn.nodemanager.vmem-check-enabled</name>

<value>false</value>

</property>

注意:端口号与里面的值,后期优化配置需要修改,第一次配可以全复制。

说明:yarn.nodemanager.vmem-check-enabled这个的意思是忽略虚拟内存的检查,如果你是安装在虚拟机上,这个配置很有用,配上去之后后续操作不容易出问题。如果是实体机上,并且内存够多,可以将这个配置去掉。

server1

server3

在<configuration>节点内加入配置(注意了,内存根据机器配置越大越好,我这里只配2个G是因为虚拟机安装测试):

重复上述步骤。

因为server1是namenode,server2和server3都是datanode,所以只需要对server1进行初始化操作,也就是对hdfs进行格式化。

执行初始化脚本,也就是执行命令:

./hadoop namenode -format

等几秒没报错就是执行成功,格式化成功后,可以在看到在/root/hadoop/dfs/name/目录多了一个current目录,而且该目录内有一系列文件。

因为server1是namenode,server2和server3都是datanode,所以只需要再server1上执行启动命令即可。

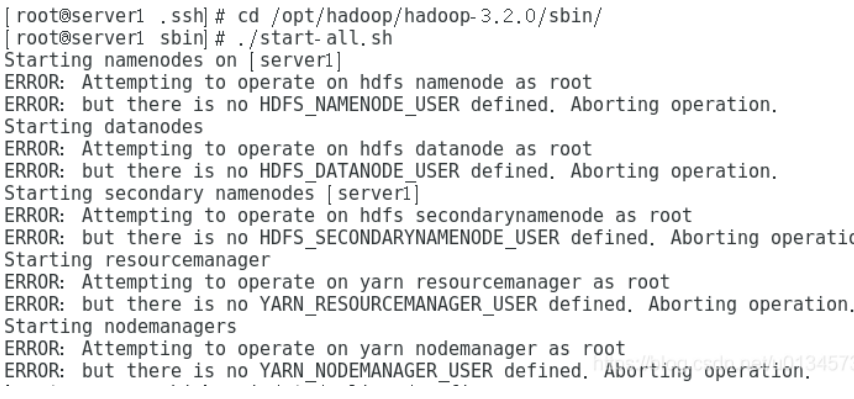

进入到server1这台机器的/opt/hadoop/hadoop-3.2.0/sbin目录

执行初始化脚本,也就是执行命令:

./start-all.sh

第一次执行上面的启动命令,会需要我们进行交互操作,在问答界面上输入yes回车。

执行过程中发生报错

解决办法:

修改start_dfs.sh stop-dfs.sh start-yarn.sh stop-yarn.sh

在start_dfs.sh 、stop-dfs.sh两个文件开头位置添加如下配置:

在start_dfs.sh 、stop-dfs.sh两个文件开头位置添加如下配置:

HDFS_DATANODE_USER=root

HADOOP_SECURE_DN_USER=root

HDFS_NAMENODE_USER=root

HDFS_SECONDARYNAMENODE_USER=root

注意:一定要是开头位置。

在start_yarn.sh 、stop-yarn.sh两个文件开头位置添加如下配置:

YARN_RESOURCEMANAGER_USER=root

HADOOP_SECURE_DN_USER=root

YARN_NODEMANAGER_USER=root

server1是我们的namanode,该机器的IP是192.168.10.198,在本地电脑访问如下地址:

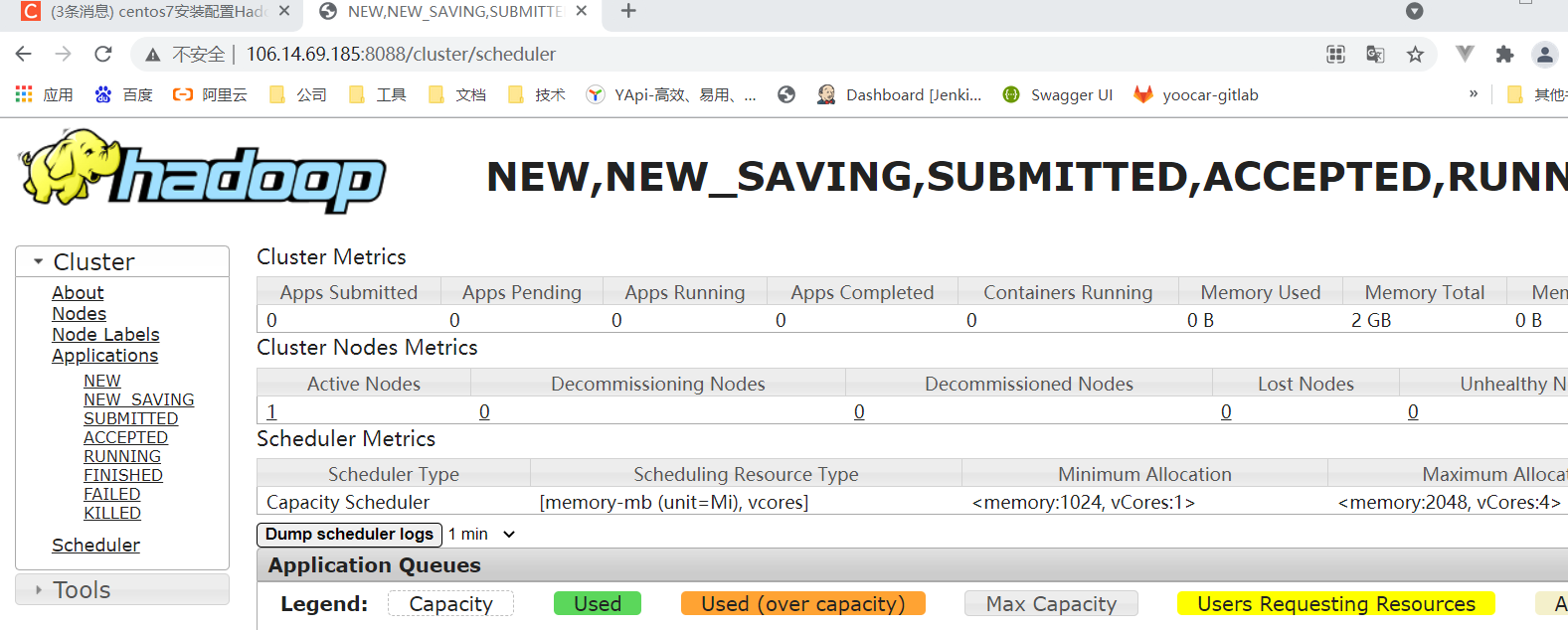

http://106.14.69.185:8088/

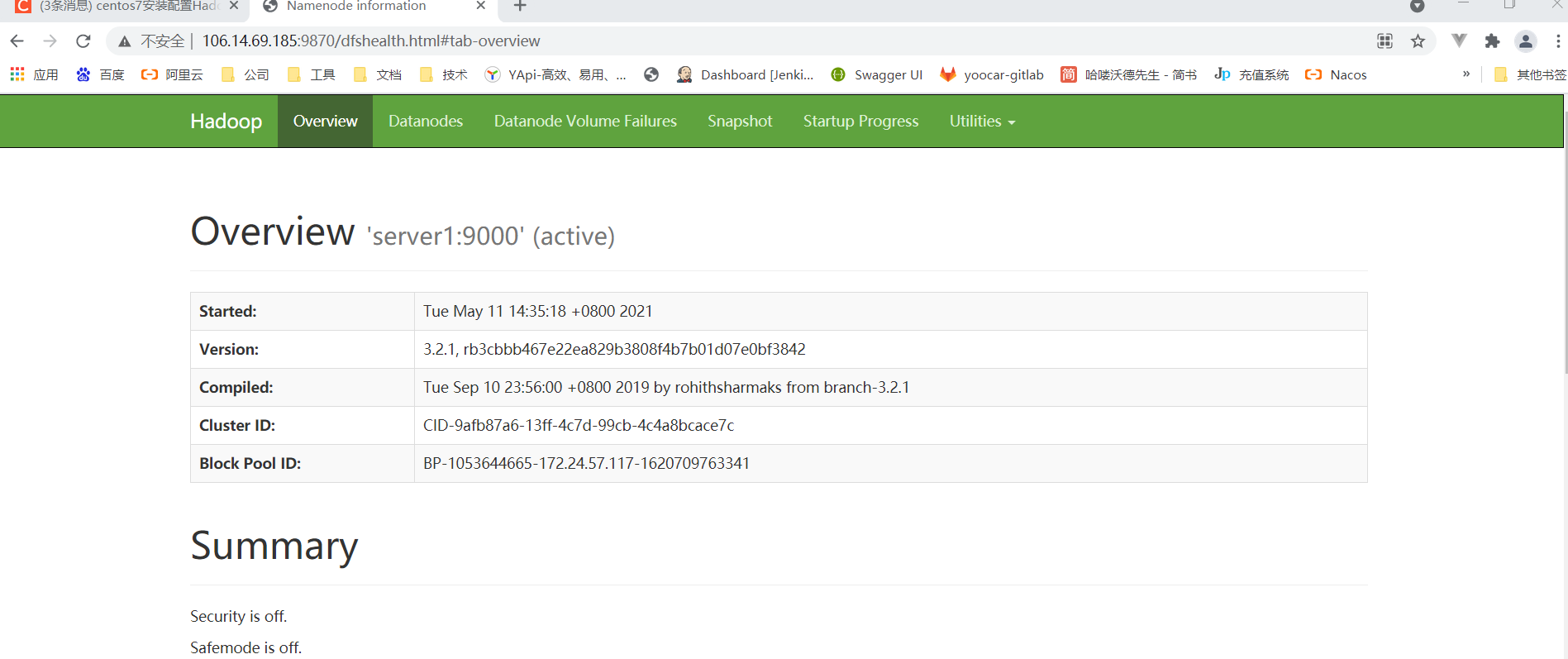

http://106.14.69.185:9870/

在/var/liangxiaodong/hadoop-3.2.1/sbin目录下

./stop-dfs.sh

部分转载 https://blog.csdn.net/u013457387/article/details/87856770

标签:rip 是你 端口冲突 centos7安装 修改 防火 tar 就是 selinux。

原文地址:https://www.cnblogs.com/kuangdong/p/14755476.html